La alfabetización académica asistida

por inteligencia artificial generativa: impacto en la calidad de la escritura

disciplinaria

Academic literacy assisted by generative artificial

intelligence: impact on the quality of disciplinary writing

Dr. José Manuel de Amo Sánchez-Fortún. Universidad de Almería. España.

Dr. José Manuel de Amo Sánchez-Fortún. Universidad de Almería. España.

Dr. Kevin Baldrich Rodríguez. Universidad

de Almería. España.

Dr. Kevin Baldrich Rodríguez. Universidad

de Almería. España.

Recibido:

2025/02/12 Revisado: 2025/11/10 Aceptado: 2025/11/21 Publicado: 2026/01/01

Cómo citar este artículo:

De Amo Sánchez-Fortún, J.M.

& Baldrich Rodríguez, K. (2026). La alfabetización académica asistida por

inteligencia artificial generativa: impacto en la calidad de la escritura

disciplinaria [Academic literacy

assisted by generative

artificial intelligence: impact

on the quality

of disciplinary writing]. Pixel-Bit. Revista de

Medios y Educación, 75, Art. 2. https://doi.org/10.12795/pixelbit.113712

RESUMEN

El presente estudio examina

el impacto de la integración de herramientas de inteligencia artificial

generativa en el desarrollo de competencias de escritura académica, con un

énfasis particular en la alfabetización disciplinar y la representación multimodal

como pilares en la construcción y comunicación efectiva del discurso

científico. La investigación, de diseño cuasiexperimental y enfoque mixto,

involucró a 150 estudiantes universitarios, organizados en un grupo

experimental que utilizó exclusivamente herramientas de IAG y un grupo de

control que aplicó estrategias de composición escrita tradicionales. Se

emplearon la escala AIAS y el modelo de intervención PAIR para garantizar que

el uso de la tecnología complementara los procesos de pensamiento crítico y la

autoría del estudiante, en lugar de sustituirlos. Los resultados, obtenidos

mediante una rúbrica validada, evaluaron aspectos clave como coherencia y

cohesión textual, corrección gramatical, manejo adecuado de referencias

bibliográfica e integración de elementos visuales. Se evidenciaron mejoras

significativas en todos los aspectos evaluados, especialmente en la capacidad

para articular discursos académicos más estructurados y en la integración

efectiva de recursos multimodales. Estos hallazgos ponen de relieve el

potencial de la IAG no solo para optimizar los procesos de escritura, sino

también para fortalecer las competencias analíticas y ampliar los recursos

expresivos de los estudiantes en contextos académicos. La investigación

evidencia la necesidad de establecer marcos pedagógicos que regulen su

implementación, fomentando el pensamiento crítico y una formación integral en

la educación superior.

ABSTRACT

The present study examines the

impact of integrating generative artificial intelligence (AI) tools into the

development of academic writing skills, with a particular emphasis on

disciplinary literacy and multimodal representation as foundational pillars for

the construction and effective communication of scientific discourse. This

quasi-experimental, mixed-methods research involved 150 university students,

divided into an experimental group that exclusively used generative AI tools

and a control group that applied traditional writing strategies. The AIAS scale

and the PAIR intervention model were employed to ensure that the use of

technology complemented critical thinking processes and student authorship

rather than replacing them. Results, obtained through a validated rubric,

assessed key aspects such as textual coherence and cohesion, grammatical

accuracy, proper handling of bibliographic references, and integration of

visual elements. Significant improvements were observed across all evaluated

aspects, particularly in the ability to articulate more structured academic

discourse and effectively integrate multimodal resources. These findings

underscore the potential of generative AI not only to optimize writing

processes but also to enhance analytical skills and expand students' expressive

resources in academic contexts. The research highlights the need to establish

pedagogical frameworks to regulate its implementation, fostering critical

thinking and comprehensive education in higher education.

PALABRAS CLAVES· KEYWORDS

Inteligencia Artificial

Generativa, alfabetización académica, educación superior, calidad de la

escritura disciplinar

Generative Artificial Intelligence, academic literacy,

higher education, quality of disciplinary writing

1. Introducción

1.1. Escritura académica y

alfabetización disciplinar

La escritura académica se

configura como un instrumento clave para la integración y la participación

activa en la comunidad científica de cada disciplina (Biber y Gray, 2010; Carlino,

2013). Su dominio no solo implica la capacidad de comunicar de manera clara y

estructurada ideas complejas, sino también de contribuir al avance del

conocimiento disciplinar mediante prácticas discursivas ajustadas a los

estándares epistemológicos y retóricos de cada campo. En el ámbito

universitario, esta formación desempeña un papel crucial para el éxito

académico del estudiantado, al favorecer la apropiación de los discursos

propios de cada ámbito disciplinar, así como el aprendizaje autónomo y

significativo.

El dominio de la escritura

en contextos académicos formales representa un desafío complejo, que abarca

aspectos como la organización discursiva, el empleo adecuado de estructuras

lingüísticas propias del registro formal y la integración crítica y pertinente

de referencias bibliográficas (McKinley, 2013). Algunas investigaciones han

demostrado que la enseñanza explícita y sistemática de estrategias de redacción

contribuye significativamente al desarrollo de competencias escriturales

avanzadas (Fathi y Rahimi,

2024; Cassany y Castelló, 2010). Sin embargo, diversos factores, como la

escasez de tiempo, recursos limitados, insuficiente formación docente y la

falta de seguimiento continuo, dificultan la implementación efectiva de

prácticas pedagógicas centradas en el desarrollo de la escritura académica (Jin

et al., 2025). Estas dificultades resaltan la necesidad de explorar enfoques

pedagógicos alternativos y herramientas de apoyo que complementen el trabajo

docente y fortalezcan los procesos de enseñanza-aprendizaje en este ámbito.

La producción académica se

ha enriquecido históricamente mediante la incorporación de modos de

representación alternativos, como imágenes, gráficos y esquemas, que, al

integrarse con herramientas digitales, potencian la claridad expositiva y

contribuyen a una estructuración más eficaz del discurso (Kress y Leeuwen, 2020; Díaz-Cuevas y Rodríguez-Herrera, 2024). La

escritura multimodal, al combinar diversas formas de comunicación, facilita la

comprensión de conceptos complejos y promueve una interacción dinámica entre el

texto y sus lectores, lo que la convierte en una estrategia pedagógica de gran

relevancia en contextos educativos (Derga et al.,

2024; Walter, 2024). En este marco, los avances en inteligencia artificial

generativa (IAG) han ampliado las posibilidades para la revisión, optimización

y enriquecimiento textual, favoreciendo una integración ética y crítica de

estos recursos en los procesos de alfabetización disciplinar y formación

académica (Wang et al., 2024).

1.2. Integración de la

inteligencia artificial generativa en la escritura académica

La incorporación de la IAG

en los procesos de composición escrita ha sido objeto de análisis crítico

debido a su capacidad para mejorar la cohesión discursiva, corregir errores

gramaticales y estructurar las ideas de manera lógica (Goulart

et al., 2024; Acosta, 2024). Estudios recientes han examinado diferentes

herramientas (ChatGPT, Copilot

y Gemini…), evidenciando su capacidad para mejorar la organización y la

claridad de los textos, optimizando su calidad antes de alcanzar la versión

definitiva (Aladini et al., 2025; Teng, 2024).

El uso de la inteligencia

artificial generativa (IAG) en los procesos de enseñanza y aprendizaje exige un

planteamiento fundamentado en principios pedagógicos sólidos y una regulación

adecuada. Sin una orientación clara, estas tecnologías pueden fomentar la

dependencia en la generación automatizada de contenido, lo que podría limitar

el desarrollo de habilidades clave como la autonomía en el aprendizaje y la

capacidad argumentativa de los estudiantes (García-Peñalvo, 2024; Kalifa y Albadawy, 2024). Por este motivo, resulta fundamental

establecer marcos pedagógicos que no solo guíen el uso de estas herramientas,

sino que también promuevan la metacognición y el pensamiento crítico,

habilidades esenciales para que el alumnado sea capaz de analizar, valorar y seleccionar

de manera fundamentada la información generada por estas tecnologías (Huang y

Teng, 2025).

Además, el desarrollo de

modelos como la escala AIAS (Artificial Intelligence Assessment Scale) ha permitido

identificar niveles de uso en los que la IAG actúa como un recurso

complementario que refuerza las capacidades del estudiante sin reemplazarlas.

Estas estrategias han demostrado ser efectivas para favorecer un aprendizaje

más autónomo y significativo, consolidando la importancia de integrar estas

tecnologías de manera ética y crítica en los procesos educativos (Perkins et

al., 2024; Ayuso y Gutiérrez-Esteban, 2022). Este enfoque resalta la necesidad

de emplear la IAG como una herramienta que enriquezca las competencias del

alumnado y fomente su desarrollo integral en entornos académicos.

1.3. Beneficios, desafíos y

consideraciones éticas en el uso de la IAG en la educación superior

El empleo de inteligencia

artificial en la escritura disciplinar ha evidenciado un impacto positivo en

múltiples dimensiones. Entre sus contribuciones más destacadas se encuentran la

optimización del tiempo dedicado a la elaboración textual, la mejora en la

precisión gramatical y estilística, así como la mitigación de bloqueos

cognitivos que suelen limitar la generación de ideas durante la redacción

(Román-Acosta, 2023). Estas tecnologías, al proporcionar retroalimentación

inmediata y detallada, favorecen la detección autónoma de errores por parte de

los estudiantes, potenciando procesos de autorregulación y fortaleciendo su

confianza en la producción escrita (Wise et al.,

2024). Este enfoque no solo amplifica las oportunidades de aprendizaje

autónomo, sino que también posiciona a la inteligencia artificial como una

herramienta con alto potencial para el desarrollo de competencias avanzadas en

escritura académica.

No obstante, la

incorporación de la inteligencia artificial generativa (IAG) en contextos

educativos plantea el desafío de una posible dependencia excesiva de estas

herramientas, lo que podría limitar el desarrollo de habilidades fundamentales

como la argumentación y la originalidad en la escritura (Davis y Csáik, 2024; Fiorillo, 2024).

Este riesgo pone de relieve la necesidad de formar a los estudiantes en el uso

crítico de estas tecnologías, promoviendo prácticas que equilibren su

integración con el fortalecimiento de competencias cognitivas y creativas (Su

et al., 2024; Pigg, 2024).

Desde una perspectiva ética

y normativa, el empleo de tecnologías emergentes plantea dudas sobre la

transparencia de los modelos y los sesgos algorítmicos, lo que preocupa a la

comunidad científica por su impacto en la equidad y la confiabilidad (Ou et al., 2024). La asistencia de la IAG en la composición

escrita supone un reto para la integridad académica, particularmente en

relación con la asignación de autoría y las limitaciones de los sistemas

actuales para identificar textos generados con estas herramientas, lo que

complica la detección de posibles casos de plagio (Casheekar

et al., 2024). En respuesta a estas cuestiones, se han desarrollado propuestas

normativas que incluyen la implementación de políticas enfocadas en el uso

ético y responsable de estas tecnologías, junto con la promoción de programas

de alfabetización digital que incorporen principios de responsabilidad

(García-Peñalvo, 2024). Además, el diseño de estrategias pedagógicas que

orienten el uso crítico y estratégico de estas tecnologías resulta fundamental

para fortalecer la capacidad analítica del estudiante durante el proceso de

revisión y edición de textos generados por IA (García-Peñalvo et al., 2024; Ciaccio, 2023).

2. Objetivos

Objetivo general

Analizar el impacto del uso

de herramientas de IAG en el desarrollo de competencias de escritura

disciplinar en estudiantes universitarios.

Objetivos específicos

-

Evaluar

la calidad de los textos académicos generados con y sin el uso de herramientas

de IAG, considerando dimensiones como la coherencia, la cohesión, la precisión

terminológica, la argumentación y la adecuación a las convenciones

disciplinares, incluidas las referencias bibliográficas.

-

Examinar

el impacto de las herramientas de IAG en las distintas fases del proceso de

escritura disciplinar, abarcando la generación de ideas, la planificación, la

estructuración del texto, la revisión y la edición.

-

Explorar

las percepciones de los estudiantes respecto al uso de herramientas de IAG en

la escritura académica, analizando su utilidad percibida, la facilidad de uso y

su influencia en la confianza y autonomía durante el proceso de redacción.

-

Determinar

la relación entre el uso de herramientas de IAG y el desarrollo de competencias

en la escritura disciplinar, evaluando en qué medida estas contribuyen a una

mejor argumentación, una estructuración lógica y un uso adecuado del lenguaje

académico.

3. Metodología

La investigación adoptó un

enfoque mixto (cuantitativo-cualitativo) y un diseño cuasiexperimental con

grupos no equivalentes, adecuado para contextos educativos donde la asignación

aleatoria no es viable (Creswell, 2014; Shadish, Cook

y Campbell, 2002). El grupo experimental integró herramientas de IAG en el

proceso de escritura académica, mientras que el grupo de control empleó

estrategias convencionales.

La intervención se ajustó al

nivel 3 de la escala AIAS (Perkins et al., 2024), que define un uso formativo y

reflexivo de la IAG. Este nivel fue elegido por su pertinencia en contextos

educativos que buscan fortalecer la autonomía del estudiante y su competencia

escritora. En este marco, la IAG actúa como mediadora cognitiva, ofreciendo

retroalimentación y apoyo estructural sin sustituir la autoría ni el

pensamiento crítico. El aprendizaje se orienta, así, hacia el desarrollo de

competencias metacognitivas y discursivas, evitando la dependencia tecnológica.

De forma complementaria, se

aplicó el marco PAIR (Problema, Selección de IA, Interacción y Reflexión) como

estructura pedagógica de la intervención. Este modelo se tradujo en la práctica

mediante secuencias de trabajo en las que los estudiantes (1) identificaban una

necesidad concreta de escritura, (2) elegían la herramienta más adecuada para

resolverla, (3) interactuaban críticamente con la IAG valorando sus sugerencias

y (4) reflexionaban sobre los cambios realizados. Este proceso permitió

incorporar la IAG como recurso dialógico en el aprendizaje, promoviendo la

autorregulación, el pensamiento crítico y la conciencia sobre el propio proceso

de escritura.

3.1. Muestra

Participaron 150 estudiantes

de cuarto curso del Grado en Educación Primaria de la Universidad de Almería

(75 en el grupo experimental y 75 en el grupo de control). El tamaño muestral

se determinó mediante un análisis de potencia (α = 0.05, potencia = 0.80,

d = 0.50), que confirmó su suficiencia para detectar diferencias significativas

entre grupos (Cohen, 1988).

La selección fue no

probabilística por conveniencia, respetando la organización preexistente de los

grupos. Se excluyeron quienes tenían experiencia previa en el uso de IAG o no

completaron todas las fases. La tasa de abandono (3.3 %) fue estadísticamente

irrelevante.

Antes de la intervención, se

aplicó una prueba diagnóstica inicial, consistente en una breve tarea de

redacción académica sobre un tema general educativo. Los textos fueron

evaluados mediante la misma rúbrica utilizada en el estudio, con el fin de

comprobar la equivalencia inicial entre grupos. Los resultados confirmaron la

homogeneidad en las habilidades de escritura (t(148) =

0.87, p = 0.382), lo que garantizó la validez de la comparación posterior de

resultados.

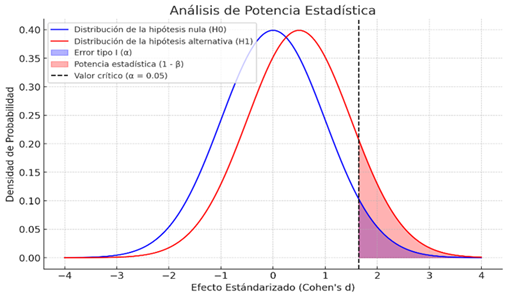

Figura 1

Análisis de potencia estadística.

Fuente: elaboración propia.

3.2. Fases del estudio

El estudio se desarrolló en

tres fases: pretest, intervención y postest.

·

Pretest.

Se solicitó la elaboración de un ensayo argumentativo sin asistencia

tecnológica (“¿Cómo puede la IA mejorar la enseñanza y el aprendizaje?”). Los

textos fueron evaluados mediante una rúbrica diseñada ad hoc con seis

dimensiones: coherencia, cohesión, corrección lingüística, solidez

argumentativa, uso de referencias y calidad de los elementos visuales.

·

Intervención.

A lo largo de cuatro semanas se desarrollaron actividades de escritura

académica con metodologías diferenciadas. El grupo experimental empleó

herramientas como ChatGPT, Copilot,

Gemini, DeepSeek, Scopus

AI, Consensus, Canva y Napkin, exclusivamente para revisar, estructurar y

optimizar textos propios, conforme al nivel 3 de la escala AIAS. El grupo de

control siguió métodos tradicionales sin mediación tecnológica.

·

Postest. Se pidió la redacción de un nuevo ensayo

argumentativo (“¿Debería regularse el uso de IA en educación?”), evaluado con

la misma rúbrica. Además, el grupo experimental completó un cuestionario de

percepción y un registro de uso de herramientas (frecuencia, tiempo y tipo de

modificaciones).

3.3. Instrumentos de

análisis de datos

Se utilizaron tres

instrumentos principales: una rúbrica de evaluación de la escritura, un

cuestionario de percepción y un registro de uso de herramientas de IAG. Todos

fueron diseñados y validados por especialistas en Didáctica de la Lengua y la

Literatura y en evaluación educativa.

El análisis de la escritura

académica se realizó mediante una rúbrica que permitió valorar las producciones

del pretest y postest con precisión y consistencia.

La rúbrica incluyó seis dimensiones: coherencia y cohesión textual, corrección

gramatical y estilística, uso adecuado de referencias bibliográficas, calidad

de gráficos y tablas, integración de elementos visuales y claridad académica.

Cada dimensión se calificó en una escala Likert de 1 (muy bajo) a 5

(excelente).

El instrumento fue sometido

a un proceso de validación por juicio de expertos, que revisaron la claridad de

los criterios y su adecuación a los objetivos del estudio. El coeficiente alfa

de Cronbach (α = 0.91) confirmó un alto grado de consistencia interna y

precisión en la evaluación.

El cuestionario de

percepción se aplicó al grupo experimental con el fin de explorar las

valoraciones del alumnado sobre el uso de herramientas de IAG en la escritura

académica. Incluyó ítems con escala Likert (1–5) y preguntas abiertas que

abordaban aspectos como la facilidad de uso, la utilidad percibida, el impacto

en la confianza y creatividad, y las dificultades en la integración

tecnológica.

Antes de su aplicación, se

llevó a cabo una prueba piloto con 20 estudiantes de características similares

a la muestra, pero ajenos a la intervención. Esta fase permitió comprobar la

claridad y pertinencia de los ítems y ajustar la redacción de dos preguntas. El

cuestionario mostró una alta fiabilidad interna (α = 0.94).

Las respuestas abiertas se

analizaron mediante codificación temática inductiva (Braun & Clarke, 2006),

desarrollada en tres fases: lectura exploratoria, codificación abierta y

agrupación de categorías. A partir de este proceso se identificaron cuatro

categorías principales:

1. Facilitación del proceso escritural,

destacando que la IAG ayudó a organizar ideas y mejorar la estructura de los

textos.

2. Optimización del uso de referencias,

valorando la capacidad de la IA para gestionar citas y fuentes.

3. Incorporación de elementos multimodales,

con impacto positivo de gráficos y visualizaciones generadas con IA.

4. Desafíos en la adaptación a la IAG,

referidos a dificultades iniciales y a la evaluación de la fiabilidad de las

sugerencias.

Por último, el registro de

uso de herramientas documentó la frecuencia y el tiempo de utilización de cada

aplicación, así como las funcionalidades empleadas en la planificación,

redacción y revisión de los ensayos. Estos datos permitieron cuantificar la interacción

con la tecnología y analizar su influencia en la mejora de la producción

escrita.

3.4. Análisis de datos

Para el análisis de datos,

se utilizó el software SPSS (IBM SPSS Statistics for Windows, Version 28.0.),

aplicando diferentes pruebas estadísticas para evaluar la evolución en la

calidad de la escritura y la relación entre el uso de las herramientas de IAG y

los resultados obtenidos. En primer lugar, se llevó a cabo un análisis de

covarianza (ANCOVA) para comparar las puntuaciones obtenidas en el postest ajustando las diferencias iniciales del pretest,

asegurando que los efectos observados fueran atribuibles a la intervención y no

a variaciones previas en los grupos. El ANCOVA fue seleccionado debido a su

capacidad para controlar posibles sesgos y mejorar la precisión de los

resultados al reducir la variabilidad no explicada. Se verificaron los

supuestos de homogeneidad de pendientes y normalidad de residuos, garantizando

la validez del modelo estadístico. Además, se calcularon los valores de F-statistic y p-value, que

permitieron determinar la significancia de las diferencias encontradas.

Junto con el ANCOVA, se

realizaron análisis descriptivos para caracterizar la frecuencia y el tiempo de

uso de las herramientas de IAG en el grupo experimental. Se documentó el número

de interacciones con cada herramienta, el tiempo total dedicado y las funcionalidades

específicas empleadas. Para complementar los análisis cuantitativos, se llevó a

cabo un análisis cualitativo de las respuestas abiertas del cuestionario,

permitiendo identificar patrones en la percepción de los estudiantes respecto a

la utilidad de las herramientas, las dificultades encontradas y el impacto en

la confianza y creatividad al escribir textos académicos.

El uso combinado de métodos

cuantitativos y cualitativos permitió obtener una visión integral del impacto

de las herramientas de IAG en la escritura académica. La inclusión del ANCOVA

en el análisis estadístico fortaleció la fiabilidad de los resultados,

asegurando que las diferencias encontradas entre el grupo experimental y el

grupo de control fueran producto de la intervención y no de factores externos.

Además, la validación de los instrumentos empleados garantizó la consistencia y

precisión de los datos recogidos. Este enfoque permitió establecer de manera

rigurosa el impacto de la inteligencia artificial en la mejora de la escritura

académica, proporcionando evidencia tanto objetiva como subjetiva sobre la

percepción y el desempeño de los participantes a lo largo del estudio.

4. Resultados

Los resultados del estudio

evidencian diferencias estadísticamente significativas entre el grupo

experimental y el grupo de control en todas las dimensiones de la escritura

académica. El análisis de covarianza (ANCOVA), con las puntuaciones del pretest

como covariable, confirmó que el uso pedagógico de la IAG produjo mejoras

sustanciales y consistentes en la calidad de los textos, tanto en su dimensión

lingüística como discursiva y multimodal. La Tabla 1 presenta las medias,

desviaciones típicas y valores F del postest en cada

una de las dimensiones evaluadas.

Tabla 1

Comparación de medias por dimensiones de escritura académica (postest)

|

Dimensión evaluada |

Grupo control (M ± DT) |

Grupo experimental (M ± DT) |

F |

p |

|

Coherencia y cohesión |

3.5 ± 0.7 |

4.7 ± 0.5 |

52.41 |

<.001 |

|

Corrección gramatical y estilística |

3.6 ± 0.6 |

4.8 ± 0.4 |

58.33 |

<.001 |

|

Uso de referencias bibliográficas |

3.4 ± 0.7 |

4.7 ± 0.5 |

49.02 |

<.001 |

|

Integración de elementos visuales |

3.3 ± 0.8 |

4.7 ± 0.6 |

54.89 |

<.001 |

|

Claridad y estilo académico |

3.5 ± 0.7 |

4.8 ± 0.5 |

56.12 |

<.001 |

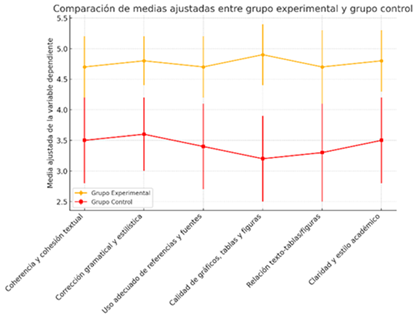

Tal como se observa en la

Figura 2, el grupo experimental presenta medias ajustadas significativamente

superiores en todas las dimensiones de la escritura académica, una vez

controladas las diferencias iniciales mediante el análisis de covarianza

(ANCOVA).

La separación constante

entre ambas líneas refleja una mejora global sostenida, especialmente en

coherencia y cohesión textual, corrección gramatical y uso de referencias.

Estas diferencias confirman que la integración pedagógica de la IAG mejoró la

calidad discursiva y estilística de los textos producidos. Las barras indican

los intervalos de confianza (95 %) de las medias ajustadas.

Figura 2

Comparación de medias ajustadas entre grupo experimental y grupo de control

(ANCOVA).

Fuente:

elaboración propia.

Uso de herramientas de IAG

El registro

de actividad del grupo experimental permitió analizar la frecuencia y duración

de uso de cada herramienta.

Como

muestra la Tabla 2, ChatGPT y Copilot fueron las más empleadas, seguidas por

Gemini y DeepSeek. Las herramientas de gestión de referencias (Scopus AI y

Consensus) y las de diseño visual (Canva y Napkin) registraron un uso moderado

pero constante, lo que evidencia una integración equilibrada entre funciones

lingüísticas, documentales y visuales.

Tabla 2

Frecuencia

y tiempo promedio de uso de herramientas de IAG (grupo experimental)

Fuente: elaboración propia.

Uso

de herramientas de IAG

El registro de actividad del

grupo experimental permitió analizar la frecuencia y duración de uso de cada

herramienta.

Como muestra la Tabla 2, ChatGPT y Copilot fueron las más

empleadas, seguidas por Gemini y DeepSeek. Las

herramientas de gestión de referencias (Scopus AI y Consensus) y las de diseño visual (Canva

y Napkin) registraron un uso moderado pero constante,

lo que evidencia una integración equilibrada entre funciones lingüísticas,

documentales y visuales.

Tabla 2

Frecuencia y tiempo promedio de uso de herramientas de IAG (grupo

experimental)

|

Herramienta |

Frecuencia

media (± DT) |

Tiempo

medio (min ± DT) |

|

ChatGPT |

9.2

± 2.1 |

125

± 15 |

|

Copilot |

7.8

± 1.9 |

110

± 14 |

|

Gemini |

6.5

± 1.6 |

95

± 12 |

|

DeepSeek |

5.9

± 1.8 |

85

± 10 |

|

Scopus

AI |

5.3

± 1.4 |

75

± 11 |

|

Consensus |

4.7

± 1.5 |

68

± 9 |

|

Canva |

4.5

± 1.2 |

62

± 8 |

|

Napkin |

3.8

± 1.0 |

55

± 7 |

Fuente: elaboración propia.

El patrón de uso muestra que

los estudiantes emplearon la IAG principalmente como recurso de apoyo en la

revisión, estructuración y optimización de sus textos, en coherencia con el

nivel 3 de la escala AIAS, que promueve un uso formativo y reflexivo de la

tecnología.

Percepciones

y análisis cualitativo

El cuestionario de

percepción aplicado al grupo experimental confirmó una valoración favorable y

generalizada del uso de herramientas de IAG en el proceso de escritura

académica.

El 95 % de los participantes

consideró que las herramientas facilitaron la generación y organización de

ideas, el 97 % percibió una mejora en la corrección gramatical y estilística, y

el 93 % destacó la contribución de los recursos visuales a la claridad y

presentación de los textos. Además, el 89 % afirmó que la IAG les ayudó a

gestionar mejor el tiempo de escritura y cumplir con los plazos de entrega.

El análisis temático de las

respuestas abiertas permitió identificar cinco categorías principales (ver

Tabla 3), que sintetizan las percepciones más representativas del alumnado.

Tabla 3

Síntesis de categorías cualitativas, evidencias y orientaciones pedagógicas

|

Categoría |

Definición |

Evidencias y códigos |

Relevancia |

Orientación pedagógica |

|

Organización

y estructuración del discurso |

Uso

de la IAG para planificar y ordenar ideas |

“esquema

previo”, “transiciones”, “mapa de ideas” |

Alta |

Promover

guías de planificación y reflexión metacognitiva. |

|

Mejora

gramatical y estilística |

Revisión

lingüística y adecuación al registro académico |

“tono

académico”, “coherencia terminológica” |

Alta |

Delimitar

la función de la IAG como apoyo, no sustituto. |

|

Gestión

de referencias |

Búsqueda

y formateo de fuentes académicas |

“verificación

de citas”, “formato APA” |

Alta |

Incluir

protocolos de trazabilidad y fiabilidad. |

|

Integración

de elementos visuales |

Uso

de gráficos y esquemas coherentes con el texto |

“resumen

gráfico”, “cohesión texto-figura” |

Media |

Diseñar

rúbricas para lectura crítica de recursos visuales. |

|

Dificultades

iniciales de uso |

Barreras

de usabilidad y comprensión de salidas |

“curva

de aprendizaje”, “opacidad de la herramienta” |

Focalizada |

Ofrecer

formación inicial y plantillas de prompts. |

Las percepciones del

alumnado confirman que la IAG se percibe fundamentalmente como un mediador

cognitivo que facilita la planificación, la revisión y la integración de

recursos, más que como un sustituto del proceso de escritura.

Los estudiantes reconocen tanto el potencial formativo de estas herramientas

como la necesidad de acompañamiento docente y reflexión crítica para garantizar

un uso ético, autónomo y consciente.

En conjunto, los resultados

cuantitativos, los registros de uso y las percepciones cualitativas convergen

en señalar que la integración didáctica y reflexiva de la IAG mejora de forma

significativa la competencia escritora del alumnado universitario.

El uso de la IA como mediadora cognitiva promueve la autorregulación, la

conciencia metalingüística y la capacidad de revisión crítica del texto propio,

siempre que se enmarque en estrategias pedagógicas que preserven la autoría, la

autonomía y la dimensión ética del aprendizaje académico.

5. Discusión y conclusiones

Los resultados de este estudio confirman que la

incorporación pedagógica de herramientas de IAG tiene un impacto positivo en la

calidad de la escritura académica universitaria, en línea con investigaciones

previas que destacan su potencial para mejorar la coherencia discursiva, la

precisión lingüística y la organización argumentativa de los textos (Amo

Sánchez-Fortún y Domínguez-Oller, 2024; Dai et al., 2023; García-Peñalvo, 2024;

Zheng et al., 2024). Las mejoras observadas en el grupo experimental, especialmente

en coherencia, corrección, uso de referencias e integración de elementos

visuales, evidencian que la IAG puede actuar como un mediador cognitivo eficaz

siempre que su uso se enmarque en una orientación formativa estructurada.

El empleo del nivel 3 de la escala AIAS y del modelo

PAIR (Problema, Selección, Interacción, Reflexión) resultó decisivo para

asegurar una integración pedagógica equilibrada de la tecnología. Este enfoque

permitió que la IAG funcionara como un recurso de apoyo al proceso de

pensamiento, y no como un sustituto del juicio académico. Así, los estudiantes

mantuvieron un rol activo en la planificación, revisión y validación de los

textos, evitando la automatización cognitiva. Este hallazgo coincide con las advertencias

de Wise et al. (2024) sobre los riesgos de una dependencia tecnológica

excesiva, que puede limitar la creatividad y el desarrollo de competencias

críticas si no se establecen marcos de uso guiado. En consonancia, Perkins et

al. (2024) señalan que un modelo de integración reflexiva ─como el

PAIR─ favorece la autonomía del estudiante y la toma de decisiones

informada sobre las aportaciones de la IA.

Desde un punto de vista epistemológico, los resultados

invitan a reconsiderar la noción de autoría académica en los entornos mediados

por inteligencia artificial. La tecnología no sustituye la voz del autor, sino

que la pone a prueba, al requerir una toma de decisiones constante sobre qué

aceptar, modificar o descartar. De este modo, la calidad del escrito no depende

solo del producto final, sino de la capacidad crítica con la que el autor

humano evalúa, ajusta y valida las sugerencias automatizadas. Esta interacción

configura un nuevo escenario de co-producción textual, donde la responsabilidad

cognitiva y la trazabilidad del proceso se convierten en ejes de la ética

académica contemporánea.

En términos pedagógicos, la integración de la IAG

favoreció la adquisición de habilidades metacognitivas. Los estudiantes no solo

mejoraron la organización discursiva y la cohesión textual ─tal como

señalan Teng (2024) y Ou et al. (2024)─, sino que también desarrollaron

una mayor conciencia sobre sus propias decisiones lingüísticas y estructurales.

Esta dimensión reflexiva es clave para prevenir la dependencia cognitiva y

consolidar una alfabetización académica crítica. Enseñar a distinguir entre lo

que la herramienta sugiere y lo que el criterio disciplinar valida se

convierte, por tanto, en una competencia central de la educación superior.

El estudio también evidenció un impacto positivo de la

IAG en el uso de referencias académicas. Las herramientas de recuperación y

gestión de información mejoraron la precisión y fiabilidad de las citas, lo que

facilitó la construcción de argumentos más sólidos y documentados.

Investigaciones recientes confirman este potencial de la IA para optimizar la

búsqueda y el procesamiento de fuentes (Dabis y Csáki, 2024; Goulart et al.,

2024), aunque advierten, al igual que este estudio, la necesidad de una verificación

sistemática y de una formación ética en la evaluación de sesgos y la opacidad

algorítmica. En este sentido, la alfabetización digital universitaria debe

incluir la enseñanza de protocolos de validación y trazabilidad de la

información generada por IA.

En el ámbito de la escritura multimodal, los

resultados muestran que la incorporación de elementos visuales y gráficos

─facilitada por herramientas como Canva o Napkin─ no solo

enriqueció la presentación de los textos, sino que fortaleció su argumentación,

al ofrecer representaciones complementarias de los conceptos. Este hallazgo

respalda las teorías de la multimodalidad que destacan la integración de

diversos modos de representación como componente esencial del discurso

académico contemporáneo (Kress y van Leeuwen, 2020; Xu et al., 2022). Así, la

alfabetización universitaria se amplía hacia una dimensión digital y multimodal

que redefine la relación entre texto, imagen y conocimiento.

Desde la perspectiva de los estudiantes, la IAG fue

percibida como útil y accesible, aunque requirió formación inicial para un uso

óptimo. Este resultado coincide con Ayuso-del Puerto y Gutiérrez-Esteban (2022)

y García-Peñalvo et al. (2024), quienes subrayan que la eficacia de las

tecnologías educativas depende en gran medida de la alfabetización digital de

los usuarios. Por ello, la integración de la IAG en la enseñanza universitaria

no puede limitarse a su dimensión instrumental: debe formar parte de un proyecto

educativo que incluya criterios de interpretación, ética y evaluación de

fiabilidad.

Finalmente, el comportamiento observado en los

participantes sugiere una interacción estratégica y reflexiva con la

tecnología: los estudiantes ajustaron y personalizaron las salidas generadas,

en lugar de aceptarlas de forma automática. Este uso consciente confirma el

potencial de la IAG como facilitador del pensamiento crítico y de la

autorregulación en el proceso de escritura (Kang et al., 2023; Pigg, 2024).

Además, el uso diferenciado de las herramientas según las fases del proceso

─textuales para la planificación y redacción; visuales para la

presentación─ coincide con los resultados de Díaz-Cuevas y

Rodríguez-Herrera (2024), que muestran cómo el impacto de la IA varía según la

tarea y el propósito del usuario.

En conclusión, este estudio demuestra que la IAG puede

desempeñar un papel transformador en la educación superior si se incorpora

dentro de marcos pedagógicos sólidos, como la escala AIAS y el modelo PAIR.

Bajo estas condiciones, las herramientas no reemplazan la autoría ni el

pensamiento crítico, sino que los amplifican. La IAG redefine así las prácticas

de alfabetización digital universitaria, orientándolas hacia una formación

integral que combine rigor disciplinar, ética de la producción académica y responsabilidad

en el uso de tecnologías generativas. En última instancia, aprender a escribir

con IA implica aprender a pensar con criterio, a dialogar con la tecnología y a

sostener la autonomía intelectual en entornos mediados por algoritmos: el nuevo

horizonte de la alfabetización académica en la era digital.

6. Limitaciones y líneas futuras

El presente estudio tiene

ciertas limitaciones que deben ser consideradas al interpretar sus resultados.

En primer lugar, la muestra utilizada fue no probabilística y estuvo conformada

por estudiantes de una única institución, lo que restringe la extrapolación de

los hallazgos a otros contextos educativos. Sería deseable que futuras

investigaciones incorporen muestras más amplias y diversas, incluyendo

estudiantes de diferentes universidades y disciplinas, para ampliar la

aplicabilidad de los resultados. En segundo lugar, la diversidad y evolución

constante de las herramientas de IAG representan un desafío. Aunque este

estudio incluyó herramientas representativas, el avance acelerado de estas

tecnologías requiere una evaluación continua para comprender su impacto en la

escritura académica de manera actualizada. Finalmente, la duración de la

intervención, limitada a cuatro semanas, impide analizar si los efectos

observados perduran en el tiempo. Diseños longitudinales podrían ser de gran

utilidad para explorar la evolución de las competencias escriturales en plazos

más prolongados.

Financiación

Esta investigación está financiada por el proyecto

«Transformación educativa: exploración del impacto de la inteligencia

artificial en el desarrollo de la lectura y la escritura de los estudiantes

universitarios» (PID2023-151419OB-I00), dentro de la convocatoria de proyectos

de I+D+i «Generación de conocimiento», del Programa Estatal de Fomento de la

Investigación Científica y Técnica y su Transferencia, como parte del Plan

Estatal de Investigación Científica, Técnica y de Innovación 2021-2023.

Ministerio de Ciencia, Innovación y Universidades. Agencia Estatal de

Investigación. 2024-2027.

Conflicto de interés

Los autores declaran no

tener ningún conflicto de interés.

Referencias

Acosta, D.R. (2024). Potential of artificial

intelligence in textual cohesion, grammatical precision, and clarity in

scientific writing. LatIA,

(2), 26. https://doi.org/10.62486/latia2024110

Aladini, A., Ismail,

S.M., Khasawneh, M.A.S., & Shakibaei,

G. (2025). Self-directed writing development across computer/AI-based tasks: Unraveling the traces on L2 writing outcomes, growth

mindfulness, and grammatical knowledge. Computers

in Human Behavior Reports, 17, 100566. https://doi.org/10.1016/j.chbr.2024.100566

Amo Sánchez-Fortún, J.M., & Domínguez-Oller, J.C.

(2024). Análisis sistémico de la alfabetización

discursiva en las prácticas académicas situadas: La escritura hipertextual en

trabajos de fin de grado. Revista de

Educación a Distancia (RED), 24(77).

https://doi.org/10.6018/red.574881

Ayuso-del P.D., &

Gutiérrez-Esteban, P. (2022). La Inteligencia Artificial como recurso educativo

durante la formación inicial del profesorado. RIED-Revista Iberoamericana de Educación a Distancia, 25(2), 347-358. https://doi.org/10.5944/ried.25.2.32332

Biber, D. & Gray, B. (2010). Challenging

stereotypes about academic writing: Complexity, elaboration, explicitness. Journal of English for Academic Purposes, 9(1),

2–20. https://doi.org/10.1016/j.jeap.2010.01.001

Carlino, P. (2013). Alfabetización académica: un

cambio necesario, algunas tensiones inevitables y ciertas estrategias posibles.

Educación en Contexto, 1(1), 1–15.

Casheekar, A., Lahiri,

A., Rath, K., Sanjay Prabhakar,

K.S. & Srinivasan, K. (2024). A contemporary review on chatbots, AI-powered

virtual conversational agents, ChatGPT: Applications, open challenges and

future research directions. Computer Science

Review, 52. https://doi.org/10.1016/j.cosrev.2024.100632

Cassany, D. & Castelló, M. (2010). Escribir y comunicar en contextos

científicos y académicos. Graó.

Ciaccio, E.J. (2023). Use of artificial intelligence

in scientific paper writing. Informatics

in Medicine Unlocked, 41, 101253. https://doi.org/10.1016/j.imu.2023.101253

Cohen, J. (1988). Statistical

power analysis for the behavioral science.

Lawrence Erlbaum Associates.

Creswell, J.W. (2014). Research Design: Qualitative, Quantitative, and Mixed Methods

Approaches. SAGE Publications.

Dabis, A., & Csáki, C. (2024). AI and ethics:

Investigating the first policy responses of higher education institutions to

the challenge of generative AI. Humanities

and Social Sciences Communications, 11(1),

1-13. https://doi.org/10.1057/s41599-024-03526-z

Dergaa, I., Chamari, K., Zmijewski, P. & Saad, H. B.

(2023). From human writing to artificial intelligence generated text: examining

the prospects and potential threats of ChatGPT in academic writing. Biology of sport, 40(2), 615-622. https://doi.org/10.5114/biolsport.2023.125623

Díaz-Cuevas, A. P. & Rodríguez-Herrera, J. (2024).

Usos de la inteligencia artificial en la

escritura académica: experiencias de estudiantes universitarios en 2023. Cuaderno de Pedagogía Universitaria, 21(42),

25-44. https://doi.org/10.29197/cpu.v21i42.595

Fathi, J. & Rahimi,

M. (2024). Utilising artificial intelligence-enhanced writing

mediation to develop academic writing skills in EFL learners: a qualitative

study. Computer Assisted Language

Learning, 1 40. https://doi.org/10.1080/09588221.2024.2374772

Fiorillo, L. (2024). Confronting the demonization of

AI writing: Reevaluating its role in upholding scientific integrity. Oral Oncology Reports, 12, 100685. https://doi.org/10.1016/j.oor.2024.100685

García-Peñalvo, F.J. (2024). Inteligencia artificial generativa y

educación: Un análisis desde múltiples perspectivas. Education in the Knowledge Society (EKS), 25, e31942-e31942. https://doi.org/10.14201/eks.31942

García-Peñalvo, F. J.,

Llorens-Largo, F. & Vidal, J. (2024). La nueva realidad de la educación

ante los avances de la inteligencia artificial generativa. RIED-Revista Iberoamericana de Educación a Distancia, 27(1), 9-39. https://doi.org/10.5944/ried.27.1.37716

Goulart, L., Matte, M. L., Mendoza, A., Alvarado,

L. & Veloso, I. (2024). AI or student writing? Analyzing

the situational and linguistic characteristics of undergraduate student writing

and AI-generated assignments. Journal of

Second Language Writing, 66, 101160. https://doi.org/10.1016/j.jslw.2024.101160

Huang, J., & Teng, M. F. (2025). Peer feedback and

ChatGPT-generated feedback on Japanese EFL students’ engagement in a foreign

language writing context. Digital Applied Linguistics, 2, 102469-102469. https://doi.org/10.29140/dal.v2.102469

Jin, F., Lin, C.H. & Lai, C. (2025). Modeling AI-assisted

writing: How self-regulated learning influences writing outcomes. Computers in Human Behavior,

165, 108538. https://doi.org/10.1016/j.chb.2024.108538

Khalifa, M. & Albadawy,

M. (2024). Using artificial intelligence in academic writing and

research: An essential productivity tool. Computer

Methods and Programs in Biomedicine Update, 5, 100145. https://doi.org/10.1016/j.cmpbup.2024.100145

Kress, G. & Van Leeuwen, T. (2020). Reading

images: The grammar of visual design. Routledge.

McKinley, J. (2013). Displaying critical thinking in

EFL academic writing: A discussion of Japanese to English contrastive rhetoric.

The East Asian Journal of Applied

Linguistics, 3(2), 133–157. https://doi.org/10.1075/eajal.3.2.04mck

Ou, A. W., Khuder, B.,

Franzetti, S., & Negretti, R. (2024).

Conceptualising and cultivating critical GAI literacy in doctoral academic

writing. Journal of Second Language

Writing, 66, Article 101156. https://doi.org/10.1016/j.jslw.2024.101156

Perkins, M., Furze, L., Roe, J., & MacVaugh, J. (2024). The Artificial Intelligence Assessment

Scale (AIAS): A framework for ethical integration of generative AI in

educational assessment. Journal of

University Teaching and Learning Practice, 21(06).

Pigg, S. (2024). Research writing with ChatGPT: A

descriptive embodied practice framework. Computers

and Composition, 71, 102830. https://doi.org/10.1016/j.compcom.2024.102830

Román-Acosta, D. D. (2023). Más allá de las palabras: Inteligencia

artificial en la escritura académica. Escritura

Creativa, 4(2), 36–43.

Shadish, W.R., Cook, T.D.,

& Campbell, D.T. (2002). Experimental

and Quasi-Experimental Designs for Generalized Causal Inference. Houghton

Mifflin.

Su, Y., Lin, Y. & Lai, C. (2023). Collaborating with

ChatGPT in argumentative writing classrooms. Assessing Writing, 57, 100752. https://doi.org/10.1016/j.asw.2023.100752

Teng, M.F. (2024). Metacognitive awareness and EFL

learners’ perceptions and experiences in utilizing ChatGPT for writing

feedback. European Journal of Education,

60, 1-16. https://doi.org/10.1111/ejed.12811

Trochim, W.M.K. (2006). Research Methods: The Essential Knowledge Base. Cengage Learning.

Walter, Y. (2024). Embracing the future of artificial

intelligence in the classroom: The relevance of AI literacy, prompt

engineering, and critical thinking in modern education. International Journal of Educational Technology in Higher Education, 21(15). https://doi.org/10.1186/s41239-024-00448-3

Wang, C., Wang, H., Li, Y., Dai, J., Gu, X., & Yu,

T. (2024). Factors influencing university students’ behavioral

intention to use GenAI: Integrating the theory of planned behavior

and AI literacy. International Journal of

Human–Computer Interaction, 1-23. https://doi.org/10.1080/10447318.2024.2383033

Wise, B., Emerson, L., Van Luyn, A., Dyson, B., Bjork,

C. & Thomas, S.E. (2024). A scholarly dialogue: writing scholarship,

authorship, academic integrity and the challenges of AI. Higher Education Research & Development, 43(3), 578-590. https://doi.org/10.1080/07294360.2023.2280195