Literacidad en Inteligencia Artificial

en la Educación Superior: Un Análisis Reflexivo sobre Necesidades Formativas y

Percepciones Estudiantiles

Artificial Intelligence Literacy in Higher Education: A

Reflective Analysis of Training Needs and Student

Dr. Emmanuel Magallanes. Universidad Politécnica de Zacatecas. México.

Dr. Emmanuel Magallanes. Universidad Politécnica de Zacatecas. México.

Dr. José Iván López Flores. Universidad Autónoma de Zacatecas. México.

Dr. José Iván López Flores. Universidad Autónoma de Zacatecas. México.

Dra. Carolina Carrillo García. Universidad Autónoma de Zacatecas. México.

Dra. Carolina Carrillo García. Universidad Autónoma de Zacatecas. México.

Recibido:

2025/09/01 Revisado: 2025/10/29 Aceptado: 2025/11/21 Publicado: 2026/01/01

Cómo citar este artículo:

Magallanes, E., López

Flores, J.I., & Carrillo García, C. (2025). Literacidad en Inteligencia

Artificial en la Educación Superior: Un Análisis Reflexivo sobre Necesidades

Formativas y Percepciones Estudiantiles [Analysis of a Practical Case of a

Didactic Model for Critical Thinking with Artificial Intelligence (AI) in

Higher Education]. Pixel-Bit, Revista de Medios y Educación, 75, Art. 4. https://doi.org/10.12795/pixelbit.117817

RESUMEN

Partiendo de una retrospectiva histórica sobre la

incorporación de la tecnología a la vida escolar, este artículo expone una

reflexión sobre la ineludible responsabilidad de la escuela en la formación

mediática y tecnológica de los estudiantes. Desde un enfoque cualitativo, se

argumenta que, como en su momento fue crucial alfabetizar en medios

tradicionales, es imperativo integrar la literacidad en inteligencia artificial

(IA) como un componente esencial del currículo. Para explorar esta necesidad

formativa, se realizó un estudio diagnóstico con 392 alumnos de diversas

universidades, aplicando una encuesta para medir sus percepciones en las

dimensiones de la literacidad en IA, desde de su utilidad hasta sus

implicaciones éticas. El análisis de datos, mediante estadística descriptiva,

revela que los estudiantes universitarios identifican una alta utilidad de la

IA principalmente en tareas instrumentales, como la redacción de textos y la

búsqueda de información. Sin embargo, reportan una escasa integración de estas

herramientas en sus procesos de aprendizaje formales y una limitada comprensión

de sus fundamentos y alcances. Esta disonancia entre el uso funcional y la

falta de integración académica subraya una brecha significativa, evidenciando

la urgencia de que las instituciones de educación superior asuman un rol

proactivo en el desarrollo de competencias en IA.

ABSTRACT

Drawing from a historical

perspective on the integration of technology into academic life, this article

reflects on the school's unavoidable responsibility in the media and

technological education of students. Using a qualitative approach, it argues

that just as traditional media literacy was once crucial, it is now imperative

to integrate artificial intelligence (AI) literacy as an essential component of

the curriculum. To explore this educational need, a diagnostic study was

conducted with 392 university students through a survey measuring their

perceptions on AI literacy, from its utility to its ethical implications. Data

analysis, using descriptive statistics, reveals that students identify a high

utility for AI, primarily in instrumental tasks such as writing texts and

searching for information. However, they report a scarce integration of these

tools into their formal learning processes and a limited understanding of their

fundamentals and scope. This dissonance between functional use and lack of academic

integration underscores a significant gap, highlighting the urgent need for

higher education institutions to assume a proactive role in developing critical

competencies in artificial intelligence.

PALABRAS CLAVES· KEYWORDS

Literacidad en Inteligencia Artificial; Educación

Superior; Competencias Digitales; Tecnología Educativa; Currículo

Universitario.

Artificial Intelligence Literacy; Higher Education;

Digital Competencies; Educational Technology; University Curriculum.

1. Introducción

No hay ningún utensilio que,

por el mero hecho de tomarlo en la mano, convierta a nadie en artesano o atleta

ni sirva para nada a quien no haya adquirido los conocimientos del oficio ni

tenga atesorada suficiente experiencia

—Platón,

La República

La IA, antes ciencia

ficción, es ahora accesible para casi todos, este acceso no garantiza su uso

correcto, entendido como uso consciente, ético y efectivo. La suposición de que

la facilidad de uso equivale a competencia es una falacia histórica que se repite

con cada nueva tecnología. En el ámbito educativo, esta idea es más peligrosa

al creerse que la tecnología, por su sola presencia, asegura un aprendizaje

profundo y sin esfuerzo.

En los inicios del cine

mudo, Béla Balázs planteaba una “Teoría del filme” que comenzaba con una serie

de reflexiones sobre la educación hasta el momento, es notorio que su teoría

fílmica iniciaba con un capítulo titulado: “Los peligros de la ignorancia” y

algunos párrafos más adelante se podía leer:

En nuestras universidades

hay cátedras de literatura y de todas las artes, excepto la del cine. La

primera Academia de Arte que incluyó la teoría del arte cinematográfico en su

plan de estudios se inauguró en Praga en 1947. Los [libros de texto] que se utilizan

en nuestras escuelas secundarias tratan sobre otras artes, pero no sobre el

arte cinematográfico. Millones de personas oyen hablar de los [grandes] de la

literatura y la pintura, pero nunca harán uso de esos conocimientos, ya que no

leen libros ni ven cuadros. Sin embargo, los millones de personas que acuden al

cine no reciben ni una sola palabra que les enseñe a apreciar el arte

cinematográfico. (Balázs, 1970, p. 18)

Señala la fecha de 1947 como

tardía, —él moriría en 1949 y la obra que contiene la cita se publicaría en

1957— incluso titula “oportunidad perdida” uno de sus capítulos. Sobre la

concepción de la cultura y del hombre culto, de manera incisiva Balázs señalaba

que una persona culta conocía vida y obra de Leonardo, Beethoven o Miguel

Ángel, sin embargo, se podría ser “una persona culta” sin conocer a Eisenstein

—director importante de la época—. Para el crítico, el público debe ir

preparado antes de enfrentarse a una obra cinematográfica. Recoge de una de sus

presentaciones un nombre para señalar esa preparación en la apreciación

cinematográfica, la llama: “film-conscious” que pudiera traducirse como

“conciencia fílmica”. Este nombre implica que no es algo espontáneo o fortuito,

sino algo que debe ser adquirido, refinado, reflexionado y trabajado. Así, el

lugar idóneo para adquirir la conciencia fílmica es precisamente la escuela:

Hasta que no haya una

historia del arte cinematográfico en todos los libros de texto sobre historia

del arte y estética; hasta que el arte cinematográfico no tenga una cátedra en

nuestras universidades y un lugar en el plan de estudios de nuestras escuelas

secundarias, no habremos consolidado firmemente en la conciencia de nuestra

generación este desarrollo artístico tan importante de nuestro siglo. (Balázs,

1970, p. 19)

Las clases de cine en la

secundaria no han aparecido, como tampoco hay unidades temáticas dedicadas a

los filmes en los libros de texto; la “conciencia fílmica” no se consolidó ni

como objetivo, ni tampoco como objeto de estudio. De acuerdo con Bálazs, no

aprendimos a realmente ver el cine. Después del cine vino la televisión, su

innegable penetración en los hogares y las instituciones la presentaba como un

medio idóneo por su alcance, pero también por su facilidad de uso. Por lo que

se pensó que para alumnos y docentes sería muy sencillo utilizarla como un

vehículo didáctico y herramienta pedagógica para el Estado. Ya desde ese

momento Ferrés y Pisticelli advertían:

La competencia mediática

exige, pues, el desarrollo de una capacidad crítica respecto al propio espíritu

crítico, porque, como consecuencia del predominio del cerebro emocional sobre

el racional, resulta más ajustado a la realidad referirse al ser humano como un

animal racionalizador que como un animal racional. (Ferrés & Piscitelli,

2012, p. 79)

Es necesaria una reflexión

sobre el medio que va mucho más allá del uso. Estos autores, particularmente

Ferrés practicaron estudios de una escala monumental, investigando ciudades

enteras de España (Ferrés Prats et al., 2012) y a una población muy diversa,

por ejemplo, en la Comunidad Autónoma de Andalucía. Encontró “graves carencias”

en la capacidad para interpretar mensajes audiovisuales de manera reflexiva y

crítica. El estudio exhibe que el grado de competencia en muchos casos no es el

óptimo. Lo anterior derriba por completo el supuesto de que la facilidad de uso

se traducirá paulatinamente en un dominio del medio o de la tecnología.

Por otro lado, cuando se

habla de carencias, es necesario identificar ¿carentes en qué? Propusieron una

serie dimensiones en las que se podría conocer el grado de competencia

mediática que tenían los individuos encuestados: “Las necesidades formativas afectan

a las seis dimensiones que componen dicha competencia: estética, lenguajes,

ideología y valores, tecnología, producción y programación, y recepción y

audiencia” (Aguaded et al., 2011, p. 99). Las dimensiones replantean el acto de

“ver televisión” como un acto comunicativo que a su vez conlleva más

implicaciones. Para realmente ver televisión se requiere un conocimiento del

lenguaje y de la lengua, pero también cinematográficos y visuales, entre otras

habilidades. Solo en este contexto la televisión puede ser realmente

aprovechada. Durante mucho tiempo a la televisión se le atribuyeron rasgos y

efectos negativos, principalmente entre las niñas y los niños y los jóvenes,

que le valieron ser llamada “la caja idiota”. Tal vez no todos los efectos sean

atribuibles a la “caja idiota” o tal vez la “idiotez” de la caja sea un reflejo

de las carencias que el usuario tiene en su competencia mediática.

En este punto se observan

similitudes en la experiencia pasada con el cine. A decir de Ferrés es

necesaria la distinción de educar con la televisión y en la televisión. El

cambio de la preposición implica una reflexión mucho más profunda, pues la

tecnología se piensa como un medio didáctico, pero poco se habla de la

educación en los medios. La competencia mediática viene de la necesidad de

conocer el grado de dominio del individuo en las dimensiones antes citadas y,

una vez más, al igual que en el cine, el mero hecho de ver televisión no las

desarrollará de manera automática, estas deben ser analizadas, reflexionadas y

enseñadas en la escuela.

En este contexto si una escuela

no enseña a ver televisión, ¿para qué mundo educa? La escuela tiene la

obligación de ayudar a las nuevas generaciones de alumnos a interpretar los

símbolos de su cultura. ¿Qué símbolos ayuda a interpretar hoy la escuela? ¿Los

de qué cultura? Si educar exige preparar a los ciudadanos para integrarse de

una manera reflexiva y crítica en la sociedad, ¿cómo se integrarán unos

ciudadanos que no están preparados para realizar de manera crítica aquella

actividad a la que más horas dedican? (Ferrés, 1994, p. 15)

Según diversas fuentes (Choi

et al., 2023; Encuesta Nacional sobre Disponibilidad y Uso de Tecnologías de la

Información en los Hogares (ENDUTIH) 2024, s/f; Estadísticas de la situación

digital de México 2023-2024 - Branch,2025; Ganson et al., 2023), el tiempo de

pantalla de los usuarios ronda las ocho horas, esto es, un tiempo similar al

que se dedica a dormir o a trabajar, de acuerdo con Ferrés, por esa razón se

debería enseñar en la escuela.

Las tecnologías digitales

como el internet trajeron desafíos, retos y muchas áreas de oportunidad en casi

todos los ámbitos de la vida cotidiana que se denominó como: “Brecha Digital”,

aunque en esencia se repetía el fenómeno de la televisión. Para Van Dijk (2017)

hablar de la brecha digital lleva a malentendidos.

Resulta revelador que antes

de la observación de Van Dijk, Ferrés hablaba de “grados” coincidiendo en el

hecho de que al hablar de “brechas” indica un vacío, casi maniqueo, se tiene o

no se tiene. Esa posición estática no permite hablar en términos de crecimiento

o mejora. Aclarado lo anterior, el error más grande al hablar de brechas es que

se habla en general, pero el autor las divide en tres clases de brechas: acceso

físico, acceso de habilidades, acceso de uso (physical access, skills access,

and usage access).

La primera brecha es la del

acceso físico, esto es, el acceso que tiene un usuario a un dispositivo, una

computadora, por ejemplo. Este acceso dependerá de la situación económica,

social, geográfica y otro tipo de variables. Sobre esto hay dos puntos más a

destacar: el primero es que es la brecha más estudiada y es la que se considera

como la más importante, atribuyendo la brecha digital a características del

individuo como la posición económica o la edad, pues se relacionan con la

capacidad de compra. En segundo término, es poca o nula la incidencia de los

docentes y la escuela en este tipo de brecha.

La segunda brecha es la de

habilidades: Destacar que el problema de la desigualdad digital no termina una

vez que se ha logrado el acceso físico, sino que, en realidad, comienza cuando

el uso de los medios digitales se incorpora a la vida cotidiana. (Van Dijk,

2017, p. 2) las ocho horas de internet antes mencionadas dan cuenta de que

definitivamente la tecnología digital ocupa un espacio muy importante en la

vida cotidiana.

Así, la segunda brecha forma

parte de las necesidades formativas de la sociedad. El autor las llama “digital

or media literacy”, puede traducirse como Literacidad Digital o Literacidad

Mediática, aunque advierte que son difíciles de conocer en tanto que no son

enseñadas de manera formal, se basa más bien en la experiencia y uso de los

individuos. De modo que coincide con Bálazs y Ferrés en que no hay una

estructuración de ese conocimiento, por ende, evaluarlo es complicado. La

tercera barrera de acceso es la del uso en sí, la usabilidad. Esta se refleja

en el tiempo de uso, pero también en la actividad y creatividad de uso, es

decir, en la apropiación tecnológica. Solo salvando las dos barreras anteriores

es posible llegar a la tercera.

Apareciendo el concepto de

Literacidad Digital, quedan desde luego dos cuestiones, definirla y desde

luego, medirla. Aunque hay muchas formas de definirla, Ala-Mutka (2011) realiza

un mapeo de la literacidad digital.

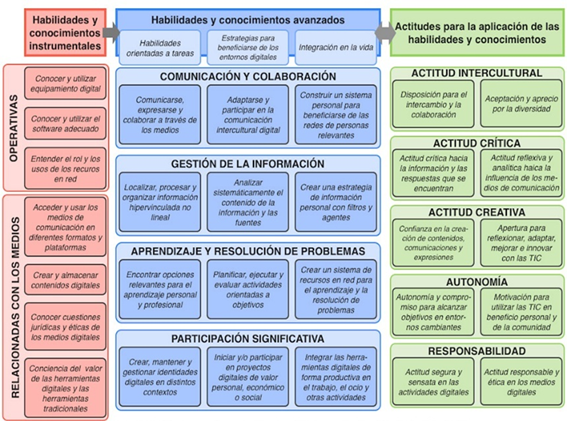

Figura 1

Mapeo

de la Literacidad Digital traducido/adaptado por Álvarez (2012)

Fuente: elaboración

propia.

A la par de la conciencia

fílmica de Bálazs y de la competencia mediática de Ferrés, Ala-Mutka plantea

una serie de elementos que la vuelven mucho más compleja, debido a la

naturaleza del medio. A diferencia del cine y la televisión, la participación

en internet es mucho más activa, no solo se reciben mensajes, sino que se

producen mensajes y contenido. Por ejemplo, la ética en los medios anteriores

consistía en la discreción de ver o no un contenido, o en su caso, mostrar o no

un contenido, en cualquier caso, la acción ética era ver o no ver. En las

herramientas digitales, la posición ética es mucho más compleja, en tanto que

consiste en la discreción de ver o compartir o editar o sugerir o crear o

modificar y otras posibilidades más.

El mapeo de Kirsti

Ala-Mutka, no descarta en ningún punto los medios anteriores como el cine o la

televisión, sino que los incorpora como parte de sus habilidades más básicas.

Además de ello, se entiende su cotidianidad como situaciones tanto de trabajo como

de ocio (Eurostat, 2018). Se establecieron niveles de dominio, habilidad, luego

competencia, luego literacidad. También se establecen conocimientos técnicos

mínimos para desenvolverse en los medios, navegar seguro y ético.

El estudio de la Literacidad

Digital aumentó significativamente alrededor del 2020 (Reddy et al., 2020,

2023; Tinmaz et al., 2022, 2023), debido al cierre de escuelas por pandemia la

literacidad digital cobró más protagonismo (Magallanes Ulloa, 2023). En gran

parte de esa producción científica hubo comunes denominadores, entre ellos, la

necesidad de integrarla al curriculum, y en los casos en que sí se incluye,

aumentar su presencia (Alowais et al., 2024; Breakstone et al., 2018; W. Ng,

2012; Reddy et al., 2023; Spante et al., 2018). Asimismo, su necesidad no solo

fue académica, sino como una posibilidad de aumentar la empleabilidad (Nikou et

al., 2022) e incluso como una variable de la salud (Arias López et al., 2023).

Apenas volviendo a la

llamada “nueva normalidad” post Covid-19, en 2022 aparecieron nuevos servicios

de Inteligencia Artificial Generativa. A diferencia de las otras tecnologías

mencionadas, la Inteligencia Artificial Generativa pulverizó de golpe las primeras

dos barreras de Van Dijk, la de acceso y la de habilidades. Si bien la

inteligencia artificial no es un concepto nuevo, pertenecía a laboratorios

secretos y películas de ciencia ficción, pero a partir de 2022 se volvió

accesible en millones de dispositivos y se integró a servicios de herramientas

ofimáticas, mensajería o correo electrónico. Además, eran, al menos

parcialmente, gratuitos. Las interfaces amigables y de tipo chat, esto es,

mediante la lengua natural, derriban casi por completo, la barrera de la

habilidad. Entonces queda solo la barrera del uso.

Para algunos (Bender, 2024;

H. Wang et al., 2020) el uso de la IA es una habilidad más que habría de

enmarcarse dentro de la Literacidad digital. Sin embargo, el consenso general

es que se debería de crear un marco propio para la IA. Long y Magerko (2020)

parten de cuatro preguntas muy simples: ¿Qué es la IA?; ¿Qué puede hacer la

IA?; ¿Cómo funciona la IA?; ¿Cómo debe utilizarse la IA? y ¿Cómo percibe la

gente la IA? La simpleza de las preguntas es lo que hace brillante el

planteamiento pues despoja de toda especialización a la IA.

De lo anterior se establecen

las primeras dimensiones para la Literacidad en Ia Conciencia, Uso, Evaluación

y Ética. La conciencia se refiere a la capacidad de identificar y comprender la

tecnología de IA durante el uso de aplicaciones relacionadas con esta. El uso

hace referencia a la capacidad de aplicar y aprovechar la tecnología de IA para

realizar tareas de manera eficaz. La evaluación implica la capacidad de

analizar, seleccionar y valorar críticamente las aplicaciones de IA y sus

resultados. La ética se refiere a la capacidad de reconocer las

responsabilidades y los riesgos asociados al uso de la tecnología de IA (Wang

et al., 2023).

Por otra parte, Ng et al.

(2021b) identificaron que la alfabetización en IA puede clasificarse en cuatro

dimensiones fundamentales: conocer y comprender la IA, utilizar y aplicar la

IA, evaluar y desarrollar IA, y considerar la ética en la IA. Touretzky et al.

(2019) propusieron cinco ideas clave IA en los niveles educativos de K-12:

percepción, representación y razonamiento, aprendizaje, interacción natural e

impacto social de la IA. Zhang et al. (2023) diseñaron un plan de estudios para

nivel secundaria enfocado en fomentar la alfabetización en IA, estructurado en

tres componentes principales: nociones básicas de IA, implicaciones éticas y

sociales, y orientación vocacional en carreras relacionadas con la IA.

De lo anterior se desprende

otro marco teórico que considera cuatro dimensiones, el marco ABCE (affective,

behavioural, cognitive and ethical). Las dimensiones ABCE del desarrollo de la

alfabetización en IA en los estudiantes comprenden cuatro ámbitos esenciales:

el aspecto afectivo, que se refiere a las actitudes, emociones e intereses

hacia la IA; el aspecto conductual, relacionado con las acciones y la

aplicación práctica del conocimiento sobre IA; el aspecto cognitivo, enfocado

en la comprensión teórica y conceptual de la IA; y la dimensión ética, que

implica la reflexión crítica sobre las implicaciones morales y sociales del uso

de esta tecnología.

De la misma forma que en el

caso de la Literacidad Digital, estas dimensiones generan un listado de

habilidades en IA.

Tabla 1

Habilidades

esenciales para el uso de la IA por diferentes autores

|

Autor(es) |

Enfoque Principal |

Componentes Clave

(Resumidos) |

|

(Long & Magerko, 2020) |

16 Competencias Holísticas |

Reconocimiento, Comprensión, Pasos del ML,

Literacidad de datos, Ética. |

|

(Ng et al., 2021a, 2021b) |

Taxonomía Cognitiva (Bloom) |

6 niveles: Saber, Comprender, Aplicar,

Analizar, Evaluar, Crear en IA. |

|

(Rizvi et al., 2023) |

4 Niveles de Profundidad |

Desde lo Social/Ético (sesgos) hasta el

"Motor" (funcionamiento técnico). |

|

(Annapureddy et al., 2024) |

Habilidades en IA Generativa |

12 habilidades: Ingeniería de prompts,

Detección de contenido, Evaluación, Ética. |

Uno de los trabajos

referentes es la Taxonomía de Bloom (1979); sus niveles taxonómicos permiten

matizar o gradar el estado de Literacidad en IA. Tanto las dimensiones como las

habilidades establecen un panorama mucho más amplio sobre el uso de la IA. Conocer

el grado de dominio o conocimiento, perfiles de usuario y tipos de uso, permite

escapar de los dualismos, “sabe o no sabe”, “tiene o no tiene” y entender que

la relación con la IA es mucho más compleja que la contratación de un servicio

o el uso específico de una aplicación específica. El entramado anterior,

posibilita formular reactivos que precisen esa relación y hacer futuras

comparaciones. El instrumento que se presenta en este estudio está basado en

dichos marcos teóricos.

2. Metodología

Se aplicó un cuestionario

digital, distribuido mediante Google Forms, a 392 estudiantes universitarios de

diversas instituciones mexicanas. El muestreo fue realizado por conveniencia.

La muestra incluyó 203 mujeres y 189 hombres, con edades entre 17 y 56 años (M

= 20.82, DE = 4.19). Los participantes se agruparon en cuatro áreas: Ingeniería

(58.16%), Ciencias Sociales (35.20%), Ciencias Básicas (3.32%) y Ciencias de la

Salud (3.32%).

El instrumento tenía dos

secciones. La primera recopiló datos sociodemográficos (edad, género,

institución, área de estudio). La segunda incluyó 47 ítems Likert organizados

en cinco dimensiones —conocimientos y habilidades, dimensión afectiva,

dimensión ética, aplicación contextual y experiencia académica— además de 8

preguntas abiertas. Las respuestas se codificaron en una escala de cuatro

puntos (1 = menor grado de acuerdo, 4 = mayor grado). Las preguntas abiertas

ofrecieron un espacio de expresión libre.

El cuestionario se abordó

con dos enfoques: cuantitativo y cualitativo. En el primero se realizó un

Análisis Factorial Confirmatorio (AFC), y el modelo de cinco factores mostró

buen ajuste (CFI = 0.914, TLI = 0.903, RMSEA = 0.043, SRMR = 0.052). Posteriormente,

para identificar subgrupos naturales en la muestra, se aplicó un análisis de

clúster. La solución de tres grupos fue la más interpretable y estadísticamente

sólida, definiendo los perfiles de “Observadores Curiosos”, “Escépticos

Informados” y “Desconectados”.

No obstante, este artículo

enfatiza el análisis cualitativo y exploratorio, incorporando todas las respuestas,

incluidas las no integradas al modelo validado, con especial atención a las

preguntas abiertas. Para el diseño de los ítems se recurrió a instrumentos

previos (Carolus et al., 2023; Hornberger et al., 2023; Koch et al., 2024) y a

formulaciones propias, adaptadas al contexto latinoamericano.

Cada subescala refleja un

componente específico de la alfabetización en IA:

·

Conocimientos

y habilidades: mide la comprensión de principios y vocabulario propios de la

IA, así como la capacidad de utilizar o explicar sus herramientas.

·

Dimensión

afectiva: alude al interés, la motivación y el confort emocional en la

interacción con sistemas de IA.

·

Conciencia

ética: incluye la responsabilidad,

el marco regulatorio y la reflexión crítica sobre las implicaciones sociales de

la IA.

·

Aplicación

contextual: valora la pertinencia y utilidad de la IA en ámbitos académicos y

profesionales.

·

Experiencia

académica: considera la interacción con herramientas, contenidos o metodologías

vinculadas a la IA en el entorno educativo formal.

Las respuestas abiertas del

cuestionario se analizaron mediante un procedimiento de análisis temático

asistido por R, orientado a identificar patrones de sentido en las percepciones

estudiantiles sobre la Inteligencia Artificial (IA).

El procesamiento se realizó

con los paquetes tidytext, dplyr, stringr y ggplot2, bajo un enfoque

exploratorio mixto. En primer lugar, se efectuó la tokenización del texto

(conversión de cada respuesta en unidades léxicas individuales) y la limpieza

léxica mediante la eliminación de signos de puntuación y de las stopwords en

español e inglés (stopwords("es"), stopwords("en")). Esto

permitió conservar únicamente palabras con significado semántico relevante,

incluyendo variantes acentuadas del español.

Posteriormente, se aplicó

una clasificación semántica inductiva basada en coincidencias léxicas que

agrupan los términos por su proximidad conceptual. Se definieron tres campos

temáticos de análisis:

1. Uso instrumental, asociado a términos como

usar, tarea, herramienta, aplicación, ayuda, escribir;

2. Comprensión conceptual, vinculado con

algoritmo, datos, procesamiento, aprendizaje, máquina, inteligencia; y

3. Reflexión ética, relacionado con ético,

moral, responsabilidad, riesgo, privacidad, plagio.

Cada palabra detectada fue

asignada automáticamente al campo correspondiente mediante expresiones

regulares (str_detect) y revisada manualmente por los investigadores para

garantizar la validez semántica de las categorías. Las ocurrencias no

clasificables se agruparon en la categoría Otro, que posteriormente se

inspeccionó para verificar la ausencia de términos relevantes. Finalmente, se

seleccionaron citas textuales representativas —anonimizadas y vinculadas a las

preguntas originales— que ilustran el sentido de cada categoría.

3. Resultados

A continuación, se comparten

algunos resultados. Primero en la dimensión de conocimiento:

Tabla 2

Comparación

de ítems sección conocimiento

|

Ítem |

Muy de acuerdo |

De acuerdo |

En desacuerdo |

Muy en desacuerdo |

Total |

|

C3. Puedo describir qué es la IA |

20.15% |

70.15% |

9.44% |

0.26% |

100.00% |

|

C1. Puedo saber si las tecnologías que uso se apoyan

en IA |

24.23% |

65.82% |

9.44% |

0.51% |

100.00% |

|

C5. Puedo explicar qué es un algoritmo |

17.86% |

55.36% |

23.47% |

3.32% |

100.00% |

|

C16. Conozco algún lenguaje de programación |

17.86% |

34.18% |

31.63% |

16.33% |

100.00% |

La Tabla 2 muestra que la

confianza disminuye conforme aumenta la especialización: los alumnos podían describir

la IA, pero tenían menos seguridad al reconocerla en tecnologías o explicar un

algoritmo, concepto básico para comprenderla.

Es importante que al usar la

IA haya al menos cierto grado de comprensión de su funcionamiento, sin llegar a

la especialización. En la IA la generatividad es un rasgo característico, que

acentúa la posibilidad de la creación. El conocer un lenguaje de programación

amplía el panorama tanto al entendimiento como al aprovechamiento del recurso.

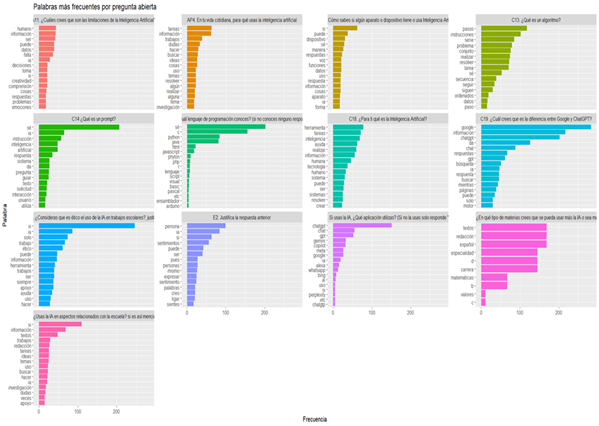

La exploración textual

permitió identificar las palabras más frecuentes en cada una de las preguntas

abiertas del cuestionario (Figura 2). Se observa una alta recurrencia de

términos asociados a la comprensión conceptual de la inteligencia artificial

(algoritmo, datos, aprendizaje, sistema), al uso instrumental en contextos

académicos (tareas, escribir, redacción, ayuda), y en menor medida, a aspectos

éticos (ético, plagio, responsabilidad).

Figura 2

Palabras

más frecuentes por pregunta abierta

Fuente: elaboración propia.

El procedimiento de

clasificación semántica generó tres temas principales: uso instrumental (n = 2213),

comprensión conceptual (n = 1401) y reflexión ética (n = 129), además de un

conjunto residual de respuestas no clasificables (n = 22 963). A partir de esta

clasificación se identificaron tres campos de sentido, que se describen a

continuación con citas representativas.

3.1. Uso instrumental

Las respuestas de este grupo

describen a la inteligencia artificial como una herramienta práctica que

facilita tareas cotidianas o académicas. Los estudiantes destacan su utilidad

para redactar textos, realizar búsquedas o resolver problemas de manera más

rápida.

Por ejemplo, ante la

pregunta “¿Para ti qué es la Inteligencia Artificial?”, algunos estudiantes

respondieron:

«Una nueva tecnología

avanzada que ayuda a resolver fácil y rápido los problemas que requieren

soluciones a base de conocimientos.»

Del mismo modo, frente a la

pregunta “¿En tu vida cotidiana, para qué usas la inteligencia artificial?”, se

señalaron usos frecuentes en redacción y apoyo académico:

«Para tareas que requieren

de un tutor. Tareas diarias. Redacción de texto, mensajes, etc.»

«Es la que nos puede ayudar

a investigar algo más rápido.»

En este campo predomina una

visión funcional de la IA centrada en la eficiencia y la productividad, con

escasa problematización conceptual o ética.

3.2. Comprensión conceptual

Las respuestas de esta

categoría revelan distintos niveles de apropiación de nociones como algoritmo,

aprendizaje o procesamiento de datos. Algunos participantes ofrecen

definiciones estructuradas, mientras que otros confunden la IA con bases de

datos o sistemas automáticos.

Ante la pregunta “¿Qué es un

algoritmo?”, algunos participantes escribieron:

«Conjunto de datos ordenados

y claros.»

En “¿Cuál crees que es la

diferencia entre Google y ChatGPT?”, se evidencia la distinción entre búsqueda

de información y generación automática de respuestas:

«Google es un buscador y

ChatGPT es inteligencia artificial creada para responder a diferentes

problemas.»

Estos enunciados evidencian

una comprensión emergente, a menudo asociada a experiencias de usuario más que

a conocimientos técnicos formales.

3.3. Reflexión ética

En este grupo aparecen

consideraciones morales sobre el uso responsable de la IA, especialmente en el

ámbito escolar. Se observa tensión entre el reconocimiento de su valor como

apoyo y la preocupación por el plagio o la pérdida de aprendizaje.

Ante la pregunta

“¿Consideras que es ético el uso de la IA en trabajos escolares?, justifica tu

respuesta”, las opiniones muestran ambivalencia:

«Sí, siempre y cuando se

utilice como una base, punto de partida, correcciones e ideas; de lo contrario

no solo no es ético, sino que es nulo el aprendizaje.»

«No lo considero ético ya que

se consideraría trampa, pero si es para fomentar tu aprendizaje sí es

éticamente correcto.»

«Es ético hasta cierto

punto, pero no en su totalidad.»

Esta categoría, aunque

minoritaria en frecuencia, refleja un incipiente posicionamiento crítico frente

a los dilemas éticos del uso de la IA en la educación.

Desde una perspectiva ética,

el 69% de los estudiantes se muestra a favor del uso de la IA para la

realización de trabajos escolares; sin embargo, un 67% considera inapropiado su

uso durante los exámenes. Al presentarles posibles aplicaciones de la IA —como

cálculos, organización de datos, resúmenes— la opción más elegida fue:

"Permitir asistencia de IA solo en la estructuración, generación de ideas,

edición o corrección, pero realizar personalmente la mayor parte del trabajo”.

En contraste, para los exámenes las opciones más elegidas fueron “En

desacuerdo” y “Muy en desacuerdo”, con 67.35%

Los estudiantes ven mayor

aplicabilidad de la IA en Lengua y Comunicación (43%), más que en su área

profesional (37%) o en matemáticas (17%). Aunado a ello se realizaron unas

series de preguntas de tipo “Uso la IA para trabajos relacionados con…” obteniendo

los siguientes resultados:

·

Cálculo

(EX5): La mayoría de los estudiantes indica usar la IA rara vez (44.64%) o

nunca (38.01%) para trabajos relacionados con cálculo. Solo un 13.78% dice

usarla casi siempre y un 3.57% siempre. Esto sugiere que en esta área, la IA se

emplea poco, posiblemente por preferencia o imposición de métodos

tradicionales.

·

Gráficas

(EX6): El patrón es similar al del cálculo.

·

Imágenes

(EX7): Hay una distribución más equilibrada; es decir, la mayoría de los

estudiantes eligieron las opciones intermedias.

·

Redacción

de textos (EX8): En esta área la IA tiene mayor presencia. El 35.97% la usa

casi siempre para redactar textos y un 10.46% siempre. Solo el 36.99% dice

usarla rara vez y apenas el 16.58% nunca. Este resultado destaca que los

estudiantes encuentran en la IA una herramienta útil y accesible para apoyar

procesos de escritura.

Aunque el 86% está de

acuerdo en que la IA debe incorporarse en el entorno escolar, el 74% señala que

no la utiliza en sus clases. Sin embargo, para los alumnos del área de

educación, el porcentaje „de acuerdo“ desciende al 75.44%. Sobre realizar

tareas, en el área de Educación el 10.53% de los estudiantes está muy de

acuerdo con usar IA para realizar tareas, mientras que el 43.86% está de

acuerdo. En el grupo de otros campos de estudio, el 15.22% se mostró muy de

acuerdo, el 62.69% de acuerdo. Estos datos reflejan una mayor aceptación del

uso de la IA en tareas escolares entre estudiantes de áreas distintas a

Educación. Hay pues una correspondencia entre aceptación, utilización y

conocimiento.

En conjunto, los resultados

cualitativos complementan los hallazgos estadísticos al evidenciar cómo el

estudiantado articula percepciones prácticas, conceptuales y éticas sobre la

inteligencia artificial, aportando una visión integral de su alfabetización en

IA.

4. Conclusiones

La selección muestral fue

por conveniencia, limitando la generalización. Los estudiantes usan más la IA

para redacción que para cálculo. La integración varía por disciplina: los de

computación muestran mayor comprensión, mientras que los de educación exhiben

rezago y escepticismo, lo que podría impactar en su futura aplicación

didáctica. En lo ético, hay consenso en su uso como complemento, con oposición

a su aplicación en evaluaciones. Manifiestan escasa integración de la IA en la

vida académica, subrayando una urgente necesidad de formación formal.

Esa es la misma urgencia que

señalaba Béla Balázs sobre el cine y que también se ha trasladado a otras

tecnologías. Es necesario aprender de las experiencias anteriores para la

incorporación pertinente de la IA en la vida escolar y también como preparación

a otros aspectos de la vida cotidiana donde la IA se vuelve cada vez más

relevante.

Financiación

Esta investigación no

recibió financiación externa

Disponibilidad de los datos

El conjunto de datos utilizados

en este estudio está disponibles previa solicitud razonable al autor

de correspondencia

Conflicto de interés

Los autores declaran no

tener ningún conflicto de interés

Referencias

Aguaded, J. I., Ferrés i Prats, J., Pérez

Rodríguez, M. A., Sánchez Carrero, J., Delgado Ponce, Á., & Cruz Díaz, M.

R. (2011). El grado de competencia mediática en la ciudadanía andaluza.

Grupo Comunicar.

Ala-Mutka, K. (2011). Mapping Digital Competence:

Towards a Conceptual Understanding.

Alowais, M., Rudd, G., Besa, V., Nazar, H., Shah, T.,

& Tolley, C. (2024). Digital literacy in undergraduate pharmacy education:

a scoping review. Journal of the American Medical Informatics Association,

31(3), 732–745. https://doi.org/10.1093/ijpp/riae013.042

Alvarez, D. (2012). Los

PLE en el marco europeo de Competencias Digitales. e-aprendizaje.

http://bit.ly/45HV76T/

Annapureddy, R., Fornaroli, A., & Gatica-Perez, D.

(2024). Generative AI Literacy: Twelve Defining Competencies. Digital

Government: Research and Practice, 6(1), 1–21.

https://doi.org/10.1145/3685680

Arias López, M. del P., Ong, B. A., Borrat Frigola,

X., Fernández, A. L., Hicklent, R. S., Obeles, A. J. T., Rocimo, A. M., &

Celi, L. A. (2023). Digital literacy as a new determinant of health: a scoping

review. PLOS Digital Health, 2(10), e0000279.

https://doi.org/10.1371/journal.pdig.0000279

Balázs, B. (1970). Theory of the Film;

Character and Growth of a New Art.

Bender, S. M. (2024). Awareness of Artificial

Intelligence as an Essential Digital Literacy: ChatGPT and Gen-AI in the

Classroom. Changing English: Studies in Culture and Education, 31(2),

161–174. https://doi.org/10.1080/1358684X.2024.2309995

Bloom, B. (1979). Taxonomía

de objetivos educativos. Alcoy Marfil.

Breakstone, J., McGrew, S., Smith, M., Ortega, T.,

& Wineburg, S. (2018). Why we need a new approach to teaching digital

literacy. Phi Delta Kappan, 99(6), 27–32.

https://doi.org/10.1177/0031721718762419

Carolus, A., Koch, M. J., Straka, S., Latoschik, M.

E., & Wienrich, C. (2023). MAILS - Meta AI literacy scale: Development and

testing of an AI literacy questionnaire based on well-founded competency models

and psychological change- and meta-competencies. Computers in Human

Behavior: Artificial Humans, 1(2), 100014.

https://doi.org/10.1016/j.chbah.2023.100014

Choi, E. J., King, G. K. C., & Duerden, E. G.

(2023). Screen time in children and youth during the pandemic: A systematic

review and meta-analysis. Global

Pediatrics, 6, 100080.

https://doi.org/10.1016/J.GPEDS.2023.100080

Encuesta

Nacional sobre Disponibilidad y Uso de Tecnologías de la Información en los

Hogares (ENDUTIH) 2024.

(s/f). Recuperado el 9 de junio de 2025, de

https://bit.ly/4n6GMXv

Estadísticas

de la situación digital de México 2023-2024 - Branch. (s/f). Recuperado el 9 de junio de 2025,

de http://bit.ly/41AdZSW

Eurostat. (2018).

Estadísticas de energía renovable. En Statistics Explained.

Ferrés, J. (1994). Televisión y educación.

Paidós.

Ferrés, J., &

Piscitelli, A. (2012). La competencia mediática: propuesta articulada de

dimensiones e indicadores. Comunicar, XIX(38), 75–82.

https://doi.org/10.3916/c38-2012-02-08

Ferrés Prats, J.,

Aguaded-Gómez, I., & García-Matilla, A. (2012). La competencia mediática de

la ciudadanía española: dificultades y retos. Revista ICONO14. Revista

científica de Comunicación y Tecnologías emergentes, 10(3), 23–42.

https://doi.org/10.7195/ri14.v10i3.201

Ganson, K. T., Nagata, J.

M., Jones, C. P., Testa, A., Jackson, D. B., & Hammond, D. (2023). Screen time,

social media use, and weight-change behaviors: Results from an international

sample of adolescents. Preventive Medicine, 168, 107450.

https://doi.org/10.1016/J.YPMED.2023.107450

Hornberger, M., Bewersdorff, A., & Nerdel, C.

(2023). What do university students know about Artificial Intelligence?

Development and validation of an AI literacy test. Computers and Education:

Artificial Intelligence, 5(June), 100165.

https://doi.org/10.1016/j.caeai.2023.100165

Koch, M. J., Carolus, A., Wienrich, C., &

Latoschik, M. E. (2024). Meta AI literacy scale: Further validation and

development of a short version. Heliyon, 10(21).

https://doi.org/10.1016/j.heliyon.2024.e39686

Long, D., & Magerko, B. (2020). What is AI

Literacy? Competencies and Design Considerations. Conference on Human

Factors in Computing Systems - Proceedings, 1–16.

https://doi.org/10.1145/3313831.3376727

Magallanes Ulloa, E. (2023).

La Literacidad Digital, el otro síntoma de la pandemia. En M. Mónica Muñoz, N.

Castillo Olvera, V. León Moncada, & Taberna Libraria Editories (Eds.), Alternativas

desde la competencia comunicativa. Educación, Violencia y Pandemia (pp.

83–97). Universidad Autónoma de Zacatecas.

Ng, D. T. K., Leung, J. K.

L., Chu, K. W. S., & Qiao, M. S. (2021a). AI Literacy:

Definition, Teaching, Evaluation and Ethical Issues. Proceedings of the

Association for Information Science and Technology, 58(1), 504–509.

https://doi.org/10.1002/pra2.487

Ng, D. T. K., Leung, J. K. L., Chu, S. K. W., &

Qiao, M. S. (2021b). Conceptualizing AI literacy: An exploratory review. Computers

and Education: Artificial Intelligence, 2. https://doi.org/10.1016/j.caeai.2021.100041

Ng, W. (2012). Can we teach digital natives digital

literacy? Computers and Education, 59(3), 1065–1078.

https://doi.org/10.1016/j.compedu.2012.04.016

Nguyen, L. A. T., &

Habók, A. (2024). Tools for assessing teacher digital literacy: a

review. Journal of Computers in Education, 11(1), 305–346.

https://doi.org/10.1007/s40692-022-00257-5

Nikou, S., De Reuver, M., & Mahboob Kanafi, M.

(2022). Workplace literacy skills—how information and digital literacy affect

adoption of digital technology. Journal of Documentation, 78(7),

371–391. https://doi.org/10.1108/JD-12-2021-0241/FULL/PDF

Oh, S. S., Kim, K.-A., Kim, M., Oh, J., Chu, S. H.,

& Choi, J. (2021). Measurement of digital literacy among older adults:

systematic review. Journal of medical Internet research, 23(2),

e26145.

Pérez, J., & Murray, M. (2018). Introducing DigLit

Score: An Indicator of Digital Literacy Advancement in Higher Education. Proceedings

of the 2018 InSITE Conference, 013–020. https://doi.org/10.28945/4037

Reddy, P., Chaudhary, K., & Hussein, S. (2023). A

digital literacy model to narrow the digital literacy skills gap. Heliyon,

9(4), 2405–8440.

https://doi.org/10.1016/J.HELIYON.2023.E14878/ATTACHMENT/C809EC21-F250-4687-A117-B85F5EDC5BF8/MMC1.DOCX

Reddy, P., Sharma, B., & Kaylash Chaudhary, F.

(2020). Digital Literacy: A Review of Literature. International Journal of

Technoethics, 11(2). https://doi.org/10.4018/IJT.20200701.oa1

Rizvi, S., Waite, J., & Sentance, S. (2023).

Artificial Intelligence teaching and learning in K-12 from 2019 to 2022: A

systematic literature review. Computers and Education: Artificial

Intelligence, 4, 100145. https://doi.org/10.1016/j.caeai.2023.100145

Spante, M., Hashemi, S. S., Lundin, M., & Algers,

A. (2018). Digital competence and digital literacy in higher education

research: Systematic review of concept use. Cogent Education, 5(1),

1–21. https://doi.org/10.1080/2331186X.2018.1519143

Tinmaz, H., Fanea-Ivanovici, M., & Baber, H.

(2023). A snapshot of digital literacy. Library Hi Tech News, 40(1),

20–23. https://doi.org/10.1108/LHTN-12-2021-0095

Tinmaz, H., Lee, Y. T., Fanea-Ivanovici, M., &

Baber, H. (2022). A systematic review on digital literacy. Smart Learning

Environments, 9(1). https://doi.org/10.1186/s40561-022-00204-y

Touretzky, D., Gardner-McCune, C., Martin, F., &

Seehorn, D. (2019). Envisioning AI for K-12: What should every child know about

AI? Proceedings of the AAAI conference on artificial intelligence, 33(01),

9795–9799.

Van Dijk, J. (2017). Digital Divide: Impact of Access.

The International Encyclopedia of Media Effects, 1–11.

https://doi.org/10.1002/9781118783764.wbieme0043

Wang, B., Patrick Rau, P.-L., & Yuan, T. (2022). Measuring

user competence in using artificial intelligence: validity and reliability of

artificial intelligence literacy scale.

https://doi.org/10.1080/0144929X.2022.2072768

Wang, B., Rau, P. L. P., & Yuan, T. (2023).

Measuring user competence in using artificial intelligence: validity and

reliability of artificial intelligence literacy scale. Behaviour and

Information Technology, 42(9), 1324–1337.

https://doi.org/10.1080/0144929X.2022.2072768

Wang, H., Liu, Y., Han, Z., & Wu, J. (2020).

Extension of media literacy from the perspective of artificial intelligence and

implementation strategies of artificial intelligence courses in junior high

schools. Proceedings - 2020 International Conference on Artificial

Intelligence and Education, ICAIE 2020, 63–66.

https://doi.org/10.1109/ICAIE50891.2020.00022

Yoon, J., Lee, M., Ahn, J. S., Oh, D., Shin, S.-Y.,

Chang, Y. J., & Cho, J. (2022). Development and validation of digital

health technology literacy assessment questionnaire. Journal of medical

systems, 46(2), 13.

Zhang, H., Lee, I., Ali, S., DiPaola, D., Cheng, Y.,

& Breazeal, C. (2023). Integrating ethics and career futures with technical

learning to promote AI literacy for middle school students: An exploratory

study. International Journal of

Artificial Intelligence in Education, 33(2),

290–324.