Estrategia lúdica analógica para el desarrollo del pensamiento

computacional y la inteligencia artificial en entornos con brecha digital

Game-based

unplugged strategy for developing computational thinking and artificial

intelligence skills in contexts with a digital divide

![]()

![]() Meliyara Sirex

Consuegra Diaz-Granados

Meliyara Sirex

Consuegra Diaz-Granados

Universidad Simón Bolívar. Colombia.

Universidad del Atlántico. Colombia.

![]()

![]() María Ángeles

Navarro Cervantes

María Ángeles

Navarro Cervantes

Universitat Oberta de Catalunya. España.

Recibido:

2025/11/11 Revisado 2025/12/01 Aceptado: 2026/02/19 Publicado: 2026/05/01

Cómo citar este artículo:

Consuegra Diaz-Granados,

M.S., Diaz Quiroz, A.E., & Navarro Fernández, M.A. (2026). Estrategia

lúdica analógica para el desarrollo del pensamiento computacional y la

inteligencia artificial en entornos con brecha digital [Game-based unplugged

strategy for developing computational thinking and artificial intelligence

skills in contexts with a digital divide]. Pixel-Bit, Revista de Medios y

Educación, 76, Art. 4. https://doi.org/10.12795/pixelbit.118850

RESUMEN

El Pensamiento Computacional

(PC) y la Inteligencia Artificial (IA) son competencias necesarias en la

sociedad de la era digital, sin embargo, su enseñanza enfrenta grandes

obstáculos en áreas rurales con acceso limitado a tecnología. Esta

investigación propone Titicode, un juego de mesa inclusivo y de bajo

coste que promueve estas habilidades en niños y jóvenes mediante un aprendizaje

lúdico y colaborativo. Para comprobar su eficacia se utilizó un instrumento

elaborado a partir del Computational Thinking Test (CTt) y el Artificial

Intelligence Literacy Questionnaire (AILQ) donde se evaluó el nivel de

conocimiento de 71 jóvenes de una escuela rural en Colombia antes y después de

la aplicación del juego, encontrando mejoras significativas después de su aplicación.

La investigación se realizó en cinco fases: elaboración de prototipo, medición

de habilidades antes del juego, implementación del juego durante 12 semanas,

medición de habilidades después del juego y análisis comparativo. Titicode

sugiere ser una herramienta eficaz para mejorar las habilidades en PC y la

alfabetización en IA en contextos con acceso limitado a la tecnología.

ABSTRACT

Computational Thinking (CT) and

Artificial Intelligence (AI) are essential competencies in the digital age;

however, teaching these competencies in rural areas with limited access to

technology faces major obstacles. This study proposes Titicode, an inclusive

and low-cost board game that promotes these skills in children and young people

through playful and collaborative learning. To assess its effectiveness, an

instrument based on the Computational Thinking Test (CTt) and the Artificial

Intelligence Literacy Questionnaire (AILQ) was used to evaluate the knowledge

level before and after the implementation of the game on 71 students from a

rural school in Colombia, revealing significant improvements after playing. The

research followed five phases: prototype development, measurement of students’

initial skills, implementation of the game over 12 weeks, post-game skill

assessment, and comparative analysis. Titicode appears to be an effective tool

to enhance skills in CT and AI literacy in contexts with limited access to

technology.

PALABRAS CLAVES· KEYWORDS

Competencia digital; Acceso

a tecnología; Inteligencia artificial; Brecha digital; Educación inclusiva

Digital

Competence; Access to Technology; Artificial Intelligence; Digital Divide;

Inclusive Education

1. Introducción

El

avance acelerado de las tecnologías digitales y su penetración en prácticamente

todos los aspectos de la vida contemporánea (Soh et al., 2025) han convertido

el Pensamiento Computacional (PC) (Wing, 2006; Grover & Pea, 2018) y la

Inteligencia Artificial (IA) (Duque-Rodríguez et al., 2024) en competencias

esenciales. Diversas investigaciones han destacado el desarrollo de estas

habilidades en la educación básica (Engelhardt et al., 2016; Voogt et al.,

2015; Nozato-López, 2024), por su relación directa con habilidades matemáticas,

lingüísticas y de razonamiento abstracto (Bers, 2020; Grover & Pea, 2013),

y su relevancia en el mercado laboral actual (Piazza & Mengual-Andrés,

2020).

Iniciativas

como AI for K-12 en Estados Unidos y Elements of AI en Europa,

han promovido la educación en PC y en IA desde edades tempranas, articulando

estándares curriculares y recursos pedagógicos accesibles (Tedre et al., 2021).

Sin embargo, la implementación de estos contenidos educativos presenta

múltiples desafíos, entre estos, la carencia de recursos didácticos accesibles,

las brechas tecnológicas entre regiones urbanas y rurales (Morales et al.,

2024) y la falta de formación docente específica (Voogt et al., 2015). Este es

el caso de diversas regiones de América Latina, donde existe una importante

desigualdad en el acceso a tecnologías (Flores & Núñez, 2024;

Quiroz-Vallejo et al., 2021). La brecha digital involucra factores de

disponibilidad técnica, inclusión social y desarrollo humano, por eso está

ligada a desequilibrios estructurales como la pobreza, la exclusión social, el

desempleo y la distribución inequitativa de los recursos (Van Dijk, 2017).

Como

solución a los desafíos planteados, esta investigación analiza un juego de mesa

como recurso unplugged [analógico], pedagógico, inclusivo,

adaptable y de bajo costo, que permite a docentes sin formación tecnológica

fomentar el aprendizaje en PC (Sin Yoon & Md Khambari, 2022) y el uso de la

IA (El-Hamamsy et al., 2022) en estudiantes de educación primaria y secundaria

(Montes-León et al, 2020).

Múltiples

investigaciones han señalado que las actividades lúdicas favorecen la

motivación del estudiante (Berland & Lee, 2011; Deterding et al., 2011) y

potencian el aprendizaje significativo, la colaboración (Zagal et al., 2006;

Kafai & Burke, 2015) y la retención de conceptos complejos (Kazimoglu et

al., 2012; Gee, 2003). Los juegos analógicos cobran importancia como

herramienta equitativa, facilitando la apropiación del conocimiento tecnológico

en contextos rurales (Vita-Barrull et al., 2023) y con limitaciones

tecnológicas (Nicolalde & Narváez, 2025) debido a que promueven el

desarrollo cognitivo, facilitan la adquisición de habilidades tecnológicas

fundamentales y fortalecen los procesos de aprendizaje (Robles et al., 2024)

desde etapas tempranas (Salleh, 2023).

Esta

investigación desarrolla y evalúa un juego de mesa denominado Titicode que

busca mejorar las habilidades en PC y la alfabetización en IA. La población

analizada está ubicada en una zona rural de la Región Caribe de Colombia, con

bajo acceso a recursos tecnológicos, poca conectividad y brechas en habilidades

digitales tanto en docentes como estudiantes (Ministerio de Tecnologías de la

Información y las Comunicaciones [MinTIC], 2025). Se realizó un diagnóstico

preliminar que permitió identificar sus niveles de familiaridad con las

nociones de lógica, algoritmos, programación y nociones básicas

Investigaciones

sobre juegos analógicos como Crabs & Turtles (Tsarava et al., 2018),

RoboBUG (Sin Yoon & Md Khambari, 2022) y Code & Go Robot

Mouse (Bakala et al., 2022), se concentran principalmente en conceptos

básicos de PC, mientras que TitiCode articula en un solo entorno lúdico

el PC y la IA, alineándose con marcos como el AI4K12 (Touretzky et al.,

2019) con un enfoque integrador, contextual y evaluativo. De esta forma, se

diseñó un recurso que mejora la experiencia de juego más allá de la

secuenciación de instrucciones, favoreciendo la motivación y la toma de

decisiones complejas, aportando al campo investigativo de la educación digital

inclusiva.

2.

Creación del juego de mesa para estimular el PC y la IA

El

diseño de Titicode parte de una perspectiva constructivista centrada en

el estudiante, reconociendo que el aprendizaje ocurre cuando existe motivación,

interacción social y oportunidad para aplicar los conocimientos en contextos

reales (Gutiérrez-Medina et al., 2024). Cada partida tiene una duración de 45 a

60 minutos con un mínimo de 2 y un máximo de 4 jugadores que se enfrentan a

desafíos y dilemas.

2.1. Componentes del juego

Titicode consta de once componentes y cuatro tipos de

cartas (Figura 1). El tablero de 9×9 y las fichas de los jugadores fortalecen

habilidades como la planificación, el pensamiento lógico y la estructuración

algorítmica (Grover & Pea, 2013), al permitir la visualización de flujos de

acción dentro de un entorno espacial concreto (Engelhardt et al., 2016).

El

reloj de arena estimula la agilidad mental y favorece la toma de decisiones

eficientes. La Caja Misteriosa incorpora elementos de sorpresa que resultan

fundamentales para el desarrollo de la abstracción, la interpretación de

eventos imprevistos y el pensamiento estratégico (Shute et al., 2017).

Las

rocas simulan errores de ejecución que requieren la aplicación de decisiones

condicionales, lo que refuerza procesos propios del PC (Kalelioğlu et al.,

2016).

Las

fichas del tablero (Error, PC, IA y NULL) profundizan la experiencia de

aprendizaje al representar principios clave del PC (Grover & Pea, 2013) y

de la IA (Ng et al., 2021), tales como el manejo de excepciones, la depuración

de errores, la interpretación de datos faltantes y la ejecución condicional

(Brennan & Resnick, 2012).

Finalmente,

el uso de gemas como metas y bananas potencia la motivación intrínseca (Kapp,

2012), el sentido de logro y la participación (Ortiz-Colón et al., 2018),

favoreciendo el aprendizaje por refuerzo (Sutton & Barto, 2018) y la

internalización de conceptos complejos (Papavlasopoulou et al., 2017).

Figura 1

Componentes del juego Titicode

Fuente: Elaboración propia

En

cuanto a las cartas, las de instrucciones de movimiento permite estructurar

acciones en secuencia lógica (Goin & Quijano, 2023). Las cartas de

depuración o error, inspiradas en juegos como Gidget (Lee et al., 2014)

y RoboBUG (Sin Yoon & Md Khambari, 2022), promueven la

identificación y corrección de errores, habilidad esencial en la programación.

Las cartas de retos de

El

diseño de TitiCode articula sus componentes lúdico-pedagógicos con las

variables analizadas en el estudio. Las cartas de instrucciones de movimiento,

el tablero 9×9, las rocas, las cartas y fichas de error y NULL, la caja

misteriosa y las cartas de retos fortalecen las habilidades en PC. Las cartas y

las fichas de IA favorecen la medición de variable alfabetización en IA.

3.

Metodología

El

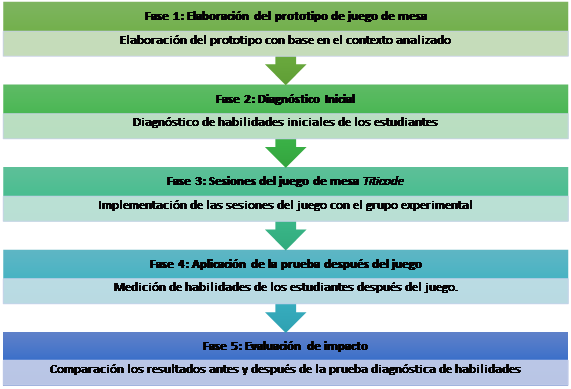

estudio se desarrolló en 5 fases (Figura 2) con datos cuantitativos mediante un

diseño cuasiexperimental (Creswell & Creswell, 2018)

Figura 2

Fases del experimento

Fuente: Elaboración propia

La

Fase 1 consistió en la creación del juego con un enfoque pedagógico adecuado

(Brennan & Resnick, 2012), garantizando su pertinencia y sostenibilidad

educativa para la generación de resultados óptimos en la apropiación de los

conceptos fundamentales en PC (Sáez-López et al., 2016) y en IA (Long &

Magerko, 2020).

En

la Fase 2 se aplicó una prueba diagnóstica de habilidades en PC y

alfabetización en IA. En la Fase 3 se implementó el prototipo del juego de mesa

durante 12 semanas, 1 sesión por semana en grupos de 3 a 4 estudiantes. En la

Fase 4, se realizó una prueba diagnóstica después del juego, para medir el

desarrollo de las variables evaluadas.

Por

último, se elaboró un análisis de los resultados con la información obtenida en

las pruebas para medir el impacto del juego en el desarrollo de las habilidades

en el PC y la alfabetización IA de los

3.1. Participantes y muestra

El

procedimiento de muestreo utilizado fue intencional y no probabilístico, donde

se seleccionaron 71 estudiantes entre 10 y 14 años, con bajo acceso a recursos

tecnológicos y brechas en habilidades digitales (MinTIC, 2025). El rango de

edad de los participantes respondió al interés de análisis en una etapa clave

del desarrollo académico, donde comienzan a enfrentarse a desafíos más

complejos y requieren herramientas que fortalezcan su pensamiento lógico y

creativo (Barragán Perea, 2023).

Esta

investigación se realizó bajo la confidencialidad de los datos recolectados,

supervisión y aval de la institución educativa, los profesores y la

universidad, y el consentimiento previo de los acudientes legales de los

estudiantes (Molina Montoya, 2018; Klock et al., 2023).

3.2. Prueba diagnóstica del conocimiento en PC e

IA

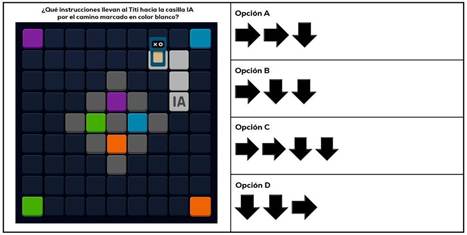

Para

analizar el impacto de Titicode en los estudiantes se utilizaron como

referencia dos pruebas: Computational Thinking test (CTt) desarrollado por

Román-González et al. (2017) y Artificial

Intelligence Literacy Questionnaire (AILQ) de Ng et al. (2024). Se

realizaron modificaciones para adaptar los cuestionarios a la población

objetivo (Mokkink et al, 2018), teniendo en cuenta que la simpleza de los

cuestionarios mejora la calidad de en la recolección de datos (De Leeuw, 2011).

De esta

forma, se construyó un instrumento de 18 preguntas, aplicado por medio de

Google Forms de forma individual y con una duración aproximada de 45 minutos

por estudiante. Con base en el CTt, las primeras 10 preguntas midieron el

desarrollo de las habilidades en PC por medio de cuatro dimensiones:

razonamiento lógico y matemático, abstracción, depuración de errores y

principios básicos de programación y secuenciación. Para asegurar la coherencia

visual entre la prueba y el juego de mesa, se realizaron adaptaciones gráficas

del CTt en las imágenes, los escenarios y los personajes de cada pregunta,

integrándolos al estilo del tablero de Titicode (Figura 3). Esta

modificación puede ser un limitante debido a que se utiliza una paleta

cromática abstracta al exigir un esfuerzo adicional para interpretar los

peligros, caminos y objetivos (Sweller et al., 2011).

Figura 3

Adaptación de la prueba al juego Titicode.

Fuente: Elaboración propia.

Con base

en el AILQ, la segunda parte de la prueba tuvo como objetivo evaluar la

alfabetización en IA calculada a partir de las dimensiones cognitiva y afectiva

(Ng et al., 2023). El aprendizaje afectivo o nivel de interés por la IA,

comprende factores que miden los sentimientos de los estudiantes en términos de

motivación intrínseca, autoeficacia, interés profesional y confianza en el

aprendizaje de IA. El aprendizaje cognitivo o nivel de conocimiento se refiere

a factores como el logro de habilidades de los estudiantes en conocer,

comprender, usar y aplicar la IA. Se simplificaron las opciones de respuesta a

una de escala de Likert de 3 puntos (1= En desacuerdo, 2= Neutral,

3= De acuerdo), para favorecer la comprensión por parte de los

participantes, evitar confusiones semánticas (Alan & Atalay, 2020; Naegeli

et al., 2018) y mejorar la consistencia y fiabilidad de las respuestas (Mellor

& Moore, 2014).

3.3. Instrumentos para el análisis de datos

El

análisis de los datos se divide en dos partes, una relativa al PC y la otra a

la IA. Ambas partes se basan en datos recolectados en las pruebas aplicadas a

los participantes antes y después de la intervención educativa con Titicode.

Para la medición

de las habilidades en PC, se utilizaron subvariables derivadas de tasas de

acierto porcentuales

Se aplicó

la prueba t de Student pareada para detectar diferencias significativas

entre las medias de las tasas de acierto antes y después de Titicode,

adecuada para muestras dependientes, permitiendo evaluar si los cambios

observados son estadísticamente significativos (con un valor p < .05

indicando rechazo de la hipótesis nula de no diferencia).

![]()

![]()

Aunque la

prueba de Shapiro–Wilk aplicada a las diferencias pareadas indicó desviaciones

significativas de la normalidad, se mantuvo el uso de la prueba t de

Student. Esta decisión se fundamenta en la robustez del contraste t frente a

violaciones del supuesto de normalidad, especialmente en muestras de tamaño

moderado o grande y cuando el interés se centra en la comparación de medias

(Sullivan & D’Agostino, 1992; Lumley et al., 2002; Norman, 2010). Asimismo,

la naturaleza discreta de las variables analizadas y la presencia de efectos

suelo y techo explican la asimetría observada en las diferencias.

Para medir

el tamaño del efecto, se utilizó la d de Cohen que cuantifica la

magnitud del cambio en términos de desviaciones estándar, con valores desde

0.20 (pequeño) a superiores a 0.80 (grande) (Cohen, 1988). En

diseños pretest–

Para

analizar el efecto en la alfabetización en IA, se emplearon variables discretas

basadas en respuestas a encuestas de tipo Likert, que capturan las dimensiones

afectivas (interés y motivación) y cognitivas (comprensión conceptual y

conocimiento).

Se utilizó

la prueba de Wilcoxon de rangos con signo, una prueba no paramétrica adecuada

para datos ordinales o discretos como los de escalas Likert (Derrick &

White, 2017), que no asumen normalidad y manejan muestras pareadas. Esta prueba

es conveniente porque evalúa diferencias en las distribuciones de rangos de las

respuestas antes y después, con un valor p < .05 indicando cambios

significativos, y es resistente a valores atípicos comunes en datos subjetivos.

![]()

![]()

Adicionalmente,

se calcula la correlación biserial de rangos para estimar el tamaño del efecto,

que adapta la correlación punto-biserial a datos ordinales y mide la fuerza de

la asociación entre la intervención (antes/después) y las respuestas.

La

consistencia interna de los instrumentos se estimó a partir de las mediciones

pretest. En el caso del CTt, compuesto por diez ítems dicotómicos, se utilizó

el coeficiente KR-20, donde se obtuvo un valor de 0.24. Siguiendo a Streiner

(2003), alfas excesivamente altas pueden reflejar redundancia entre ítems más

que una adecuada representación del constructo evaluado. En pruebas de logro

educativo que integran

Por

su parte, la consistencia interna del AILQ, integrado por ocho ítems de

naturaleza afectiva y cognitiva, se estimó mediante el coeficiente alfa de

Cronbach, donde se obtuvo

4.

Resultados obtenidos

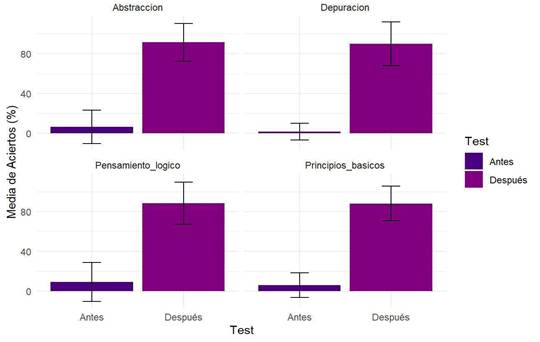

4.1. Habilidades en PC

Los

resultados evidencian mejoras significativas en todas las dimensiones

analizadas (Figura 4), con un aumento en el rango de aciertos de menos del 6%

antes de la intervención de Titicode a cerca del 90% después. Este

cambio debe interpretarse considerando la baja exposición previa a contenidos

de PC, por lo que pequeñas variaciones iniciales generan grandes incrementos

porcentuales sin sobrestimar el efecto. La Tabla 1 muestra medias, desviaciones

estándar e intervalos de confianza al 95% antes y después de la intervención,

confirmando un efecto suelo en el pretest y un posible efecto techo en el

postest en algunas dimensiones.

Estadísticos descriptivos de las habilidades en

|

Variable |

Test |

N

|

Media

(DE) |

IC(95%) |

|

Razonamiento

lógico y matemático |

Antes |

71 |

9.29

(19.58) |

[4.62, 13.96] |

|

Razonamiento

lógico y matemático |

Después |

71 |

88.57

(21.15) |

[83.53, 93.61] |

|

Abstracción |

Antes |

71 |

6.43

(16.86) |

[2.41,

10.45] |

|

Abstracción |

Después |

71 |

91.43

(18.98) |

[86.90, 95.95] |

|

Depuración

o Error |

Antes |

71 |

1.43

(8.39) |

[0.00, 3.43] |

|

Depuración

o Error |

Después |

71 |

90.00

(21.87) |

[84.79, 95.21] |

|

Principios

básicos en programación y secuenciación |

Antes |

71 |

6.07 (12.36) |

[3.12, 9.02] |

|

Principios

básicos en programación y secuenciación |

Después |

71 |

88.21 (17.40) |

[84.06, 92.36] |

Figura 4

Media de tasa de acierto por dimensión en las

pruebas de habilidades en PC

Fuente:

Elaboración propia.

Los

resultados de las pruebas inferenciales confirman las mejoras observadas en el

análisis descriptivo, destacando diferencias significativas y efectos de gran

magnitud atribuidos a la intervención con Titicode.

La

prueba t de Student pareada (Tabla 2) revela diferencias altamente

significativas en todas las variables, con valores p extremadamente

bajos, lo que rechaza la hipótesis nula y confirma que los cambios no son

aleatorios.

Pueba t

student y d de Cohen en habilidades en PC

|

Variable |

t de Student

(df=70) |

Valor p |

d de Cohen |

Efecto |

|

Razonamiento

lógico y matemático |

23.0 |

< .001 |

3.89 |

Muy grande |

|

Abstracción |

28.9 |

< .001 |

4.74 |

Muy grande |

|

Depuración

o Error |

32.5 |

< .001 |

5.35 |

Muy grande |

|

Principios

básicos en programación y secuenciación |

32.9 |

< .001 |

5.44 |

Muy grande |

La

Tabla 2 también muestra una d de Cohen muy alta en todos los casos subrayando

el impacto pedagógico sustancial de la intervención.

En

el razonamiento lógico-matemático se observa una transición de bajo rendimiento

a un dominio sólido, reforzando la capacidad de aplicar instrucciones

estructuradas en tareas como movimientos de personajes o dibujos. En

abstracción, el gran efecto (d = 4.74) indica una mejora notable en la

identificación de pasos faltantes y en la conceptualización, aspectos clave

para la programación. La depuración presenta uno de los cambios más marcados (d

= 5.35), reflejando avances en la corrección de errores. Por último, los

principios básicos de programación muestran el efecto más elevado (d = 5.44),

evidenciando una mejora sustancial en secuenciación y repetición de

instrucciones gracias a una intervención práctica eficaz.

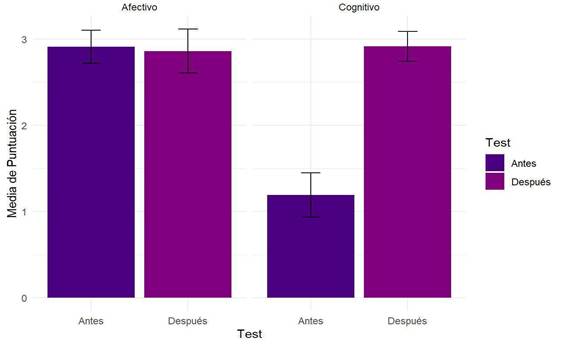

4.2. Alfabetización en IA

La

Figura 5 compara las medias de las puntuaciones (en una escala Likert de 1 a 3,

donde 1 = "En desacuerdo", 2 = "Neutral" y 3 = "De

acuerdo") obtenidas para las dos variables analizadas antes y después de

la intervención de Titicode. Cada panel representa una dimensión

(Afectiva y Cognitiva), acompañada de barras de error que indican la desviación

estándar.

Figura 5

Puntuaciones

Likert por dimensión en la prueba de alfabetización en IA

Fuente: Elaboración propia

La

prueba de Wilcoxon de rangos con signo y la correlación biserial de rangos

revelan patrones diferenciados (Tabla 3). Para la dimensión afectiva, el valor p

(.289) es mayor a .05, no rechazando la hipótesis nula e indicando ausencia de

diferencias significativas entre los resultados de la prueba diagnóstica antes

y después de la intervención. La correlación biserial es baja (.089),

confirmando un efecto mínimo y sugiriendo que la intervención no alteró

notablemente los aspectos motivacionales.

Tabla 3

Estadístico

de Wilcoxon y correlación biserial

|

Variable |

Estadístico de

Wilcoxon |

Valor p |

Correlación

biserial |

|

Afectivo |

2316 |

.289 |

.089 |

|

Cognitivo |

5041 |

< .001 |

.898 |

Para la

dimensión cognitiva, el valor p es extremadamente bajo, rechazando la

hipótesis nula y confirmando diferencias altamente significativas. La

correlación biserial alta (.898) denota un efecto grande, validando la

efectividad de Titicode en mejorar la alfabetización en IA desde la

dimensión cognitiva.

5.

Discusión

Titicode se muestra como una herramienta efectiva para

el desarrollo del PC en edades tempranas con valor pedagógico y lúdico, al

igual que otros juegos como Crabs & Turtles (Tsarava et al., 2018) y

Code & Go Robot Mouse (Bakala et al., 2022).

A diferencia de otros juegos analógicos, Titicode puede mejorar la

alfabetización IA, lo cual no se había analizado en investigaciones anteriores.

No

obstante, la interpretación de estos hallazgos requiere considerar determinadas

condiciones metodológicas. Los tamaños del efecto elevados pueden estar

influenciados por el bajo nivel inicial de desempeño de la muestra, lo que

apunta a un posible efecto suelo en el pretest y a la amplificación de los

cambios tras la intervención, así como a un efecto techo en algunas dimensiones

del postest.

La

estrecha alineación entre los objetivos de la intervención y el instrumento

refuerza la validez interna, pero sugiere la conveniencia de incorporar en

futuras investigaciones medidas complementarias que permitan evaluar la

transferencia del aprendizaje a otros contextos.

El

uso de un muestreo no probabilístico limita la generalización de los resultados

y la ausencia de un grupo de control dificulta aislar el efecto de la

intervención frente a posibles amenazas a la validez interna, como el

aprendizaje asociado a la repetición. A pesar de ello, la coherencia pedagógica

del diseño del juego y la consistencia de las mejoras observadas sugieren que

los cambios no pueden atribuirse exclusivamente a estos factores, sino que

responden, en buena medida, a la intervención educativa implementada.

6.

Conclusiones

Los

hallazgos de esta investigación demuestran el potencial de Titicode como

una estrategia didáctica, efectiva e inclusiva que puede transformar conceptos

abstractos en experiencias concretas, mejorando las habilidades en PC y la

alfabetización en IA de estudiantes en entornos con bajo acceso a la

tecnología. Su versatilidad permite que sea replicado y escalado en diversos

entornos educativos.

De

acuerdo con las pruebas aplicadas, los estudiantes pasaron de niveles de

acierto inferiores al 6% antes de la intervención del juego, a niveles en torno

al 90% en todas las dimensiones de PC analizadas, demostrando ser un método

significativo. En el ámbito de la IA, desde la dimensión cognitiva se logró una

mejora en la comprensión de los conceptos fundamentales, y desde la dimensión

afectiva, se encontró que las actitudes emocionales hacia la IA fueron altas

antes y después de la intervención.

Diversas

líneas de investigación se abren a partir de este análisis, como la evaluación

de su impacto a largo plazo, explorar su aplicación en otro tipo de

poblaciones, profundizar en la incorporación de componentes emocionales, de

motivación, de gamificación avanzada, o de apropiación crítica de las

tecnologías emergentes.

Finalmente,

esta propuesta demuestra que los juegos de mesa pueden ser aliados estratégicos

en la educación, adaptables para diferentes iniciativas orientadas al

desarrollo de competencias clave en la era digital.

Contribución de los autores

Autor

1: conceptualización, metodología, validación, análisis formal, investigación,

supervisión, visualización, redacción – borrador original, redacción—revisión y

edición. Autor 2: conceptualización, creación del juego, metodología,

validación, análisis formal, investigación, visualización, redacción – borrador

original, redacción—revisión y edición; Autor 3: metodología, software,

análisis formal, redacción-revisión y edición, visualización.

Financiación

Esta

investigación no ha recibido financiación externa.

Aprobación

ética

La intervención cuenta con el

aval del Comité de Ética de la Universidad Simón Bolívar mediante el Acta de

Aprobación de Proyectos No.0539 para el Proyecto PRO-CEI-USB-CE-0606-00.

Conflicto de interés

Los autores declaran que no existe conflicto de

intereses.

Referencias

Alan, Ü., &

Atalay Kabasakal, K. (2020). Effect of number of

response options on the psychometric properties of Likert-type scales used with

children. Studies in Educational Evaluation, 66, 100895. https://doi.org/10.1016/j.stueduc.2020.100895

Bakala, E., Gerosa, A., Hourcade, J. P., Tejera, G.,

Peterman, K., & Trinidad, G. (2022). A Systematic Review of Technologies to

Teach Control Structures in Preschool Education. Frontiers in psychology, 13,

911057. https://doi.org/10.3389/fpsyg.2022.911057

Barragán Perea, E. A. (2023). Pensamiento computacional y

programación en la formación de estudiantes desde edades tempranas. Revista

Educación, 47(2), 1–18. https://doi.org/10.15517/revedu.v47i2.53645

Berland, M. &

Lee, V. R. (2011). Collaborative Strategic Board Games as a Site

for Distributed Computational Thinking. International Journal of Game-Based

Learning (IJGBL), 1(2), 65-81. https://doi.org/10.4018/ijgbl.2011040105

Bers, M. U. (2020). Coding as a playground:

Programming and computational thinking in the early childhood classroom

(2nd ed.). Routledge. https://doi.org/10.4324/9781003022602

Brennan, K., & Resnick, M. (2012). New Frameworks

for Studying and Assessing the Development of Computational Thinking. Proceedings

of the 2012 Annual Meeting of the American Educational Research Association, 1,

Vancouver, 13-17 April 2012, 25. http://bit.ly/3JKzzhf

Casal-Otero, L., Catala, A., Fernández-Morante, C.,

Taboada, M, Cebreiro, B. & Barro, S. (2023). AI

literacy in K-12: a systematic literature review. International Journal of

STEM Education, 10(29). https://doi.org/10.1186/s40594-023-00418-7

Cohen, J. (1988). Statistical Power Analysis for

the Behavioral Sciences (2nd ed.). Routledge. https://doi.org/10.4324/9780203771587

Cortina, J. M. (1993). What is coefficient alpha? An

examination of theory and applications. Journal of Applied Psychology, 78(1),

98–104. https://doi.org/10.1037/0021-9010.78.1.98

Creswell, J. W., & Creswell, J. D. (2018). Research

design: qualitative, quantitative, and mixed methods approaches. Fifth

edition. SAGE. http://bit.ly/45Ah7QU

De Leeuw, E. D. (2011). Improving data quality when

surveying children and adolescents: Cognitive and social development and its

role in questionnaire construction and pretesting. Academy of Finland

Conference Report. http://bit.ly/43NjzTn

Del-Moral-Pérez, M.E., López-Bouzas, N., &

Castañeda-Fernández, J. (2025). Microrrelatos, codificación robótica,

aplicaciones digitales y realidad aumentada para potenciar el pensamiento

computacional infantil [Micro-stories, Robotic Coding, Digital Applications,

and Augmented Reality to Enhance Children's Computational Thinking]. Pixel-Bit.

Revista de Medios y Educación, 73, art.8. https://doi.org/10.12795/pixelbit.115193

Derrick, B., & White, P. (2017). Comparing Two

Samples from an Individual Likert Question. International Journal of

Mathematics and Statistics, 18(3), 1-13. http://bit.ly/40FWa4i

Deterding, S., Sicart, M., Nacke, L., O’Hara, K. &

Dixon, D. (2011). Gamification: Using game design elements in non-gaming

contexts. Proceedings of the 2011 Annual Conference Extended Abstracts on

Human Factors in Computing Systems, 66, 2425 - 2428. https://doi.org/10.1145/1979742.1979575

Duque-Rodríguez,

J., Piña-Ferrer, L., Isea-Argüelles, J., & Comas-Rodríguez, R. (2024).

Aprendizaje tecnológico desde los primeros años de escolaridad en la era de la

inteligencia artificial. CIENCIAMATRIA, 10(18), 151-167. https://doi.org/10.35381/cm.v10i18.1247

El-Hamamsy, L.,

Zapata-Cáceres, M., Barroso, E. M., Mondada, F., Zufferey, J. D., & Bruno,

B. (2022). The Competent Computational Thinking Test:

Development and Validation of an Unplugged Computational Thinking Test for

Upper Primary School. Journal of Educational Computing Research, 60(7),

1818-1866. https://doi.org/10.1177/07356331221081753

Engelhardt, K., Punie, Y., Chioccariello, A., Ferrari,

A., Dettori, G., Kampylis, P., & Bocconi, S. (2016). Developing

computational thinking in compulsory education – Implications for policy and

practice, Punie, Y.(editor) and Kampylis, P.(editor), Publications Office.

https://data.europa.eu/doi/10.2791/792158

Flores Jaramillo,

J. D., & Nuñez Olivera, N. R. (2024). Aplicación de Inteligencia Artificial

en la Educación de América Latina: Tendencias, Beneficios y Desafíos. Revista Veritas De Difusão Científica, 5(1),

01–22. https://doi.org/10.61616/rvdc.v5i1.52

Gee, J. P. (2003). What video games have to teach us

about learning and literacy. Computers in Entertainment (CIE), 1(1), 20.

https://doi.org/10.1145/950566.95059

Goin, M. M. J., & Quijano, M. T. (2023). Desarrollo y análisis de un

juego de mesa algorítmico para favorecer el pensamiento computacional. Revista

Iberoamericana De Tecnología En Educación Y Educación En Tecnología, (35),

e10. https://doi.org/10.24215/18509959.35.e10

Grover, S. & Pea, R. (2013). Computational

Thinking in K–12: A Review of the State of the Field. Educational

Researcher, 42(1), 38-43. https://doi.org/10.3102/0013189X12463051

Grover, S., & Pea, R. (2018). Computational

Thinking: A Competency Whose Time Has Come. In S. Sentance , E. Barendsen &

C. Schulte (Ed.). Computer Science Education: Perspectives on Teaching and

Learning in School (pp. 19–38). London. Bloomsbury Academic. Retrieved

June 12, 2025, from http://dx.doi.org/10.5040/9781350057142.ch-003

Gutiérrez-Medina,

L., Arrué-Quezada, G., & Illanes-Aguilar, L. (2024). Juegos de mesa como

inductor de la Motivación para el aprendizaje en adolescentes: Una revisión

sistemática. Revista de estudios y experiencias en educación, 23(52),

195-213. https://doi.org/10.21703/rexe.v23i52.2429

Kafai, Y. B., & Burke, Q. (2015). Constructionist gaming: Understanding the benefits of making games for

learning. Educational Psychologist, 50(4), 313-334. https://doi.org/10.1080/00461520.2015.1124022

Kalelioğlu, F., Gülbahar, Y., & Kukul, V.

(2016). A framework for computational thinking based on

a systematic research review. Baltic Journal of Modern Computing, 4(3),

583-596. https://bit.ly/4moM1SR

Kapp, Karl. (2012). The gamification of learning

and instruction: Game-based methods and strategies for training and education.

San Francisco, CA: Pfeiffer. https://doi.org/10.1145/2207270.2211316

Kazimoglu, C., Kiernan, M., Bacon, L. & MacKinnon, L.

(2012). Learning Programming at the Computational

Thinking Level via Digital Game-Play. Procedia Computer Science,

9, 522-531. https://doi.org/10.1016/j.procs.2012.04.056

Klock, A.C.T., Santana, B.S., Hamari, J. (2023). Ethical Challenges in Gamified Education Research and Development: An

Umbrella Review and Potential Directions. In: Toda, A., Cristea, A.I., Isotani,

S. (eds) Gamification Design for Educational Contexts. Springer, Cham. https://doi.org/10.1007/978-3-031-31949-5_3

Lakens, D. (2013). Calculating and reporting effect

sizes to facilitate cumulative science: A practical primer for t-tests and

ANOVAs. Frontiers in Psychology, 4(863). https://doi.org/10.3389/fpsyg.2013.00863

Lee, M. J., Bahmani, F., Kwan, I., Laferte, J.,

Charters, P., Horvath, A., Luor, F., Cao, J., Law, C., Beswetherick, M., Long,

S., Burnett, M., & Ko, A. J. (2014). Principles of a debugging-first puzzle

game for computing education. In Proceedings - 2014 IEEE Symposium on Visual

Languages and Human-Centric Computing VL/HCC, Melbourne VIC, Australia,

57-64. https://doi.org/10.1109/VLHCC.2014.6883023

Long, D. & Magerko, B. (2020). What is AI

Literacy? Competencies and Design Considerations. In Proceedings of the 2020

CHI Conference on Human Factors in Computing Systems (CHI '20). Association

for Computing Machinery, New York, NY, USA, 1–16. https://doi.org/10.1145/3313831.3376727

Lumley, T., Diehr, P., Emerson, S., & Chen, L.

(2002). The importance of the normality assumption in large public health data

sets. Annual review of public health, 23(1), 151-169. https://doi.org/10.1146/annurev.publhealth.23.100901.140546

Mellor, D. & Moore, K.A. (2014). The Use of Likert

Scales With Children. Journal of Pediatric Psychology, 39 (3), 369–379. https://doi.org/10.1093/jpepsy/jst079

Ministerio de

Tecnologías de la Información y las Comunicaciones (MinTIC). (2025, 17 de

diciembre). Índice Sintético Educación Digital 2022-2023. Observatorio Nacional

de Tecnologías de la Información y las Comunicaciones (ONTIC). Recuperado de https://bit.ly/45TsjIq

Mokkink, L. B.,

Terwee, C. B., Patrick, D. L., Alonso, J., Stratford, P. W., Knol, D. L.,

Bouter, L. M., & de Vet, H. C. W. (2018). COSMIN

methodology for systematic reviews of Patient-Reported Outcome Measures

(PROMs): User manual. http://bit.ly/3HJFemV

Molina Montoya,

N. P. (2018). Aspectos éticos en la investigación con niños. Ciencia Y

Tecnología Para L a Salud Visual Y Ocular, 16(1), 75-87. https://doi.org/10.19052/sv.4348

Montes-León, H.,

Hijón- Neira, R., Pérez-Marín, D., & Montes-León, S. R. (2020). Mejora del

Pensamiento Computacional en Estudiantes de Secundaria con Tareas Unplugged. Education in the Knowledge Society (EKS), 21(12).

https://doi.org/10.14201/eks.23002

Morales

Jaramillo, M., Sosa Toapanta, J., Garofalo Sosa, G., & Escobar Contreras,

K. (2024). La inteligencia artificial una herramienta benéfica o perjudicial

para el aprendizaje académico en el Ecuador. Polo del

Conocimiento, 9(12), 1476-1490. https://doi.org/10.23857/pc.v9i12.8557

Naegeli, A. N., Hanlon, J., Gries, K. S., Safikhani, S.,

Ryden, A., Patel, M., Crescioni, M., & Vernon, M. (2018). Literature review to characterize the empirical basis for response scale

selection in pediatric populations. Journal of patient-reported outcomes,

2 (39). https://doi.org/10.1186/s41687-018-0051-8

Ng, D.T.K., Leung, J.K.L, Chu, S.K.W. & Qiao,M.S. (2021) Conceptualizing AI

literacy: An exploratory review. Computers and Education: Artificial

Intelligence, 2, 100041, ISSN 2666-920X. https://doi.org/10.1016/j.caeai.2021.100041

Ng, D.T.K., Leung, J.K.L., Su, J., Ng, R.C.W. &

Chu, S.K.W. (2023) Teachers’ AI digital competencies and twenty-first century

skills in the post-pandemic world. Education Tech Research and development,

71, 137-161. https://doi.org/10.1007/s11423-023-10203-6

Ng, D.T.K., Wu, W., Leung, J.K.L., Chiu, T.K.F., &

Chu, S.K.W. (2024). Design and validation of the AI literacy questionnaire: The

affective, behavioural, cognitive and ethical approach. British Journal of

Educational Technology, 55(3), 1082–1104. https://doi.org/10.1111/bjet.13411

Nicolalde Jaramillo, S.G., & Narvaéz Valverde,

M.M. (2025). La

inteligencia artificial en la educación básica: innovaciones, desafíos y

perspectivas futuras. Revista Ecos De La

Academia, 11(21), e1218. https://doi.org/10.53358/ecosacademia.v11i21.1218

Norman, G. (2010). Likert scales, levels of

measurement and the “laws” of statistics. Advances in health sciences

education, 15(5), 625-632. https://doi.org/10.1007/s10459-010-9222-y

Nozato-López, M. J. (2024). La inteligencia artificial en

educación: consideraciones éticas y fomento al pensamiento crítico. RECIE. Revista

Electrónica Científica De Investigación Educativa, 8, e2357. https://doi.org/10.33010/recie.v8i0.2357

Ortiz-Colón,

A.-M., Jordán, J., & Agreda, M. (2018). Gamificación en educación: una

panorámica sobre el estado de la cuestión. Educação

& Pesquisa, 44, e173773. https://doi.org/10.1590/S1678-4634201844173773

Papavlasopoulou, S., Giannakos, M. N., & Jaccheri, L.

(2017). Empirical studies on the Maker Movement, a

promising approach to learning: A literature review. Entertainment

Computing, 18, 57-78. https://doi.org/10.1016/j.entcom.2016.09.002

Piazza, A., & Mengual-Andrés, S. (2020).

Computational thinking and coding in primary education: scientific productivity

on SCOPUS. Pixel-Bit,

Revista de Medios y Educación, 59, 147–181. https://doi.org/10.12795/pixelbit.79769

Quiroz-Vallejo, D.

A., Carmona-Mesa, J. A., Castrillón-Yepes, A., & Villa-Ochoa, J. A. (2021).

Integración del pensamiento computacional en la educación primaria y secundaria

en Latinoamérica: una revisión sistemática de literatura. RED. Revista de

Educación a Distancia, 21(68), Artíc. 7. https://doi.org/10.6018/red.485321

Robles Carmona, E. J., Vergara Oliveros, J. J., Giraldo

Cardozo, J. C., & Madera Doval, D. P. (2024). Enfoque stem+ y gamificación

para desarrollar el pensamiento computacional en educación básica. Acta

ScientiÆ InformaticÆ, 8(8), 23-28. https://doi.org/10.21897/26192659.3642

Rodríguez-Martínez,

J. A., González-Calero, J. A., & Sáez-López, J. M. (2019). Computational thinking and mathematics using Scratch: an experiment with

sixth-grade students. Interactive Learning Environments, 28(3), 316–327.

https://doi.org/10.1080/10494820.2019.1612448

Román-González, M., Pérez-González, J.-C., &

Jiménez-Fernández, C. (2017). Which cognitive abilities underlie computational

thinking? Criterion validity of the Computational Thinking Test. Computers

in Human Behavior, 72, 678–691. https://doi.org/10.1016/j.chb.2016.08.047

Sáez-López,

J.-M., Román-González, M., & Vázquez-Cano, E. (2016). Visual programming languages integrated across the curriculum in

elementary school: A two-year case study using “Scratch” in five schools. Computers

& Education, 97, 129-141. https://doi.org/10.1016/j.compedu.2016.03.003

Salleh Hudin, S. (2023). A Systematic Review of the

Challenges in Teaching Programming for Primary Schools’ Students. Online

Journal for TVET Practitioners, 8(1), 75-88. https://publisher.uthm.edu.my/ojs/index.php/oj-tp/article/view/13350

Shute, V. J., Sun, C., & Asbell-Clarke, J. (2017).

Demystifying computational thinking. Educational Research Review, 22,

142–158. https://doi.org/10.1016/j.edurev.2017.09.003

Sin Yoon, C., & Md Khambari, M.N. (2022). Design,

Development, and Evaluation of the Robobug Board Game: An Unplugged Approach to

Computational Thinking. International Journal of Interactive Mobile

Technologies (IJIM), 16(06), 41–60. https://doi.org/10.3991/ijim.v16i06.26281

Soh, J., Oikonomou, M., Pizzinelli, C., Shibata, I.

& Tavares, M. M. (2025) Did the

Covid-19 Recession Increase the Demand for Digital Occupations in the USA?

Evidence from Employment and Vacancies Data. IMF Economic Review, 73,

316–337. https://doi.org/10.1057/s41308-024-00246-x

Streiner,

D. L. (2003). Starting at the Beginning: An Introduction to Coefficient Alpha

and Internal Consistency. Journal of Personality Assessment, 80(1),

99–103. https://doi.org/10.1207/S15327752JPA8001_18

Suárez-Ibujés, M. O., Hernández-Dávila, C. A.,

Peñafiel, E. J. A., & Villena-Atoche, C. A. (2024). Utilización de juegos de

razonamiento lógico para potenciar competencias matemáticas en estudiantes de

bachillerato. MQR Investigar, 8(2),

2931–2950. https://doi.org/10.56048/MQR20225.8.2.2024.2931-2950

Sullivan, L. M., & D'Agostino, R. B. (1992). Robustness of the t test applied to data distorted from normality by

floor effects. Journal of dental research, 71(12),

1938-1943. https://doi.org/10.1177/00220345920710121601

Sutton, R. S., & Barto, A. G. (2018). Reinforcement

learning: An introduction (2nd ed.). A Bradford Book, The MIT Press. http://bit.ly/3JF8ADW

Sweller, J., Ayres, P., & Kalyuga, S.

(2011). Cognitive load theory. Springer. https://doi.org/10.1007/978-1-4419-8126-4

Tedre, M., Toivonen, T., Vartiainen, H., Jormanainen, I.,

Valtonen, T., Kahila, J. & Pears, A. (2021). Teaching

Machine Learning in K–12 Classroom: Pedagogical and Technological Trajectories

for Artificial Intelligence Education. IEEE Access, 9, 110558-110572. https://doi.org/10.1109/ACCESS.2021.3097962

Touretzky, D., Gardner-McCune, C., Martin, F., &

Seehorn, D. (2019). Envisioning AI for K-12: What Should Every Child Know about

AI?. Proceedings of the AAAI Conference on Artificial Intelligence, 33(1),

9795-9799. https://doi.org/10.1609/aaai.v33i01.33019795

Tsarava, K., Moeller, K., M., & Ninaus, M. (2018). Training Computational Thinking through board games: The case of Crabs

& Turtles. International Journal of Serious Games, 5(2), 25-44. https://doi.org/10.17083/ijsg.v5i2.248

Tseng, C. Y. (2020). Exploring the Learning Effect

of Playing Card Games to Develop Computational Thinking Skills: Supporting

Pattern Recognition and Generalization. http://dx.doi.org/10.13140/RG.2.2.30111.64163

Van

Dijk, J. (2017). Digital divide: Impact of access. In P. Rössler, C. A.

Hoffner, & L. van Zoonen (Eds.), The international encyclopedia of media

effects (pp. 1–11). John Wiley & Sons. https://doi.org/10.1002/9781118783764.wbieme0043

Vita-Barrull, N., Estrada-Plana, V., March-Llanes, J.,

Guzmán, N., Fernández-Muñoz, C., Ayesa, R., & Moya-Higueras, J. (2023).

Board game-based intervention to improve executive functions and academic

skills in rural schools: A randomized controlled trial. Trends in

neuroscience and education, 33, 100216. https://doi.org/10.1016/j.tine.2023.100216

Voogt, J., Fisser, P., Good, J., Mishra, P. &

Yadav, A. (2015). Computational thinking in compulsory education: Towards an

agenda for research and practice. Education and Information Technologies,

20, 715-728. https://doi.org/10.1007/s10639-015-9412-6

Wing, J. (2006). Computational thinking. Communications

of the ACM, 49(3), 33-35. https://doi.org/10.1145/1118178.1118215

Zagal, J. P., Rick, J., & Hsi, I. (2006).

Collaborative games: Lessons learned from board games. Simulation & Gaming, 37(1), 24-40. https://doi.org/10.1177/1046878105282279